Новый алгоритм яндекс. Все об алгоритмах "яндекса"

В результате технологического прогресса стало возможным производить необходимые операции, не выходя из дому. Теперь даже работать можно через Сеть, и многие уже давно неплохо чувствуют себя на этом поприще. Самый распространенный вид заработка в Интернете - создание собственного сайта или блога. Благодаря размещенной на ресурсе рекламе его владелец может получать хорошую прибыль. Правда, эта схема работает только тогда, когда сайт или блог находятся на первых страницах поиска. Проще говоря, от количества посетителей на ресурсе зависит уровень дохода его владельца.

И первое, что нужно знать, приступая к такой деятельности, - как работают поисковые алгоритмы, в частности алгоритмы "Яндекса", самой большой поисковой системы Рунета.

Что такое поисковые алгоритмы?

Поисковые алгоритмы, они же алгоритмы "Яндекса", представляют собой некую математическую формулу, где запрос пользователя является неизвестным. Поисковый робот решает эту формулу: подставляет вместо неизвестного разные значения и выбирает самое подходящее.

Если упростить определение, то можно выразиться следующим образом: поисковый алгоритм - это специальная программа, которая забирает «проблему», в нашем случае поисковый запрос, и дает ее «решение», то есть показывает список сайтов с необходимой пользователю информацией.

Решая «проблему», алгоритм просматривает все ключевые слова на страницах, сортирует полученные данные и формирует нужную для пользователя поисковую выдачу. Благодаря поисковому алгоритму, роботы могут анализировать содержимое каждого ресурса. На основе полученной информации определяется положение сайта в поисковой выдаче.

Что влияет на поисковый алгоритм?

Как уже можно было заметить, поисковая выдача по одному и тому же запросу в разных поисковых системах разная. Так, алгоритм "Яндекса" значительно отличается от Google. Например, для чистоты эксперимента откроем две вкладки: одна поисковая система от "Яндекс", другая - от Google. Если ввести в строку поиска запрос «как уехать в Японию на ПМЖ», то можно увидеть, что первый сайт в выдаче "Яндекс" находится на втором месте в выдаче Google.

Алгоритмы поисковиков находятся под строгим секретом, они анализируют одни и те же параметры сайта, но каким уделяют больше внимания, а каким меньше - никому не известно. Даже СЕО-оптимизаторы задаются этим вопросом.

Параметры, с которыми работают алгоритмы

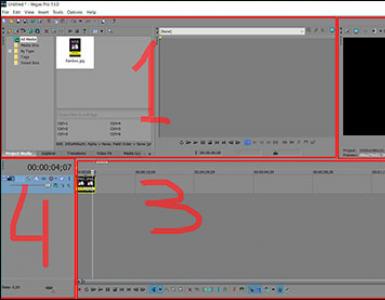

Как уже было сказано, поисковые алгоритмы "Яндекса" руководствуются определенными параметрами. В целом их можно разделить на две группы. Одни параметры отвечают за смысловое наполнение ресурса, их можно условно назвать «текстовыми». Другие - характеризуют технические характеристики (дизайн, плагины и т. д.). Условно можно обозначить их как «инженерно-функциональные». Для наглядности стоит разбить все параметры по группам и разместить в таблице.

«Текстовые» | «Инженерно-функциональные» |

Язык ресурса | Возраст сайта, доменное имя, местоположение. |

Популярность темы и количество текста на каждой странице. | Количество страниц и их «вес» |

Соотношения ключевых слов к общему количеству текста. | Наличие стилевого решения |

Количество цитат и уровень уникальности контента | Количество запросов по конкретному ключевому слову и частота обновляемой информации. |

Размер шрифта и его тип | Наличие мультимедийных файлов, фреймов, флэш-модулей и мета-тегов |

Число ссылок в тексте | Стиль заголовков, подзаголовков и КС |

Соответствие ключевых слов разделу каталога, где зарегистрирован сайт. | Комментарии в программном коде, тип страницы, наличие дублей |

Ранжирование

Эти параметры играют ключевую роль в алгоритмах ранжирования. Алгоритм ранжирования - это способ, благодаря которому можно узнать ценность каждой страницы. Проще говоря, если сайт имеет хорошие показатели по всем этим параметрам, то он будет находиться выше в поисковой выдаче.

Алгоритмы ранжирования "Яндекса" меняются практически каждый год. Основные из них названы в честь городов. Название новой поисковой концепции начинается с последней буквы названия предыдущего алгоритма. Так, поисковая система создала алгоритмы:

- "Магадан" (2008 год).

- "Находка" (2008 год).

- "Арзамас" (2009 год).

- "Снежинск" (2009 год).

- "Конаково" (2010 год).

- "Обнинск" (2010 год).

- "Краснодар" (2010 год).

- "Рейкьявик" (2011 год).

- "Калининград" (2012 год).

- "Дублин" (2013 год).

- "Началово" (2014 год).

- "Одесса" (2014 год).

- "Амстердам" (2015 год).

- "Минусинск" (2015 год).

- "Киров" (2015 год).

Помимо них, в последние два года вышло еще три поисковых алгоритма "Яндекса". А также существуют особые алгоритмы АГС-17 и АГС-30, основная задача которых - искать ресурсы, которые не удовлетворяют требованиям. Проще говоря, эти алгоритмы ищут сайты с неуникальным контентом и обилием ключевых слов, а после применяют к ним штрафные санкции. А теперь о каждом алгоритме понемногу.

Алгоритмы 2008-2011 годов

За два года "Яндекс" создал четыре поисковых алгоритма, которые качественно отличались от предыдущих, начальных версий. В 2008 году впервые в поисковом ранжировании начали учитывать уникальность контента ("Магадан"). Впервые была введена новая система, которая принимала во внимание наличие стоп-слов ("Находка").

В 2009 году алгоритм поиска "Яндекс" начал учитывать регион пользователя, появился новый классификатор геозависимых и геонезависимых запросов. Значительно улучшилась региональная формула подбора ответов ("Арзамас"). Сильно изменилась выдача, появилось 19 новых формул регионального ранжирования и обновились критерии геонезависимого ранжирования ("Снежинск", "Конаково").

В 2010 году алгоритмы поисковых систем "Яндекс" активно разрабатывали новые формулы для геозависимых и геонезависимых запросов ("Обнинск", "Краснодар"). 2011 год ознаменовался началом создания персонализированной выдачи, стали учитываться языковые предпочтения интернет-пользователей.

Поисковое ранжирование 2012-2014 годов

В 2012 году персонализация выдачи существенно изменилась: стали учитывать интересы пользователей в долгосрочной перспективе, повышалась релевантность часто посещаемых сайтов ("Калининград"). В 2013 году алгоритм "Яндекса" уже умело подстраивал результаты поисковой выдачи под интересы конкретного пользователя во время сессии, учитывал кратковременные интересы ("Дублин"). В 2014 году был отменен учет ссылок для коммерческих запросов при ранжировании ответов ("Началово").

"Амстердам", "Минусинск", "Киров"

В поисковой выдаче возле результата начала появляться карточка с информацией при наведении на ссылку курсора ("Амстердам"). Впервые задачей алгоритма "Яндекс" стало понижение в ранжировании ресурсов, что имели много СЕО-ссылок. Наличие обширного ссылочного профиля стало основной причиной потери позиций. Алгоритм "Минусинск" "Яндекса" начал массово снимать СЕО-ссылки, немного позже учет ссылочных факторов вернули, но только в Московском регионе.

В третьем за этот год алгоритме была внедрена рандомизация релевантных запросов. Проще говоря, при выдаче запросы можно было сортировать по дате, популярности или региону ("Киров").

"Владивосток" и "Палех"

Алгоритм "Владивосток", начавший функционировать в начале 2016 года, стал учитывать адаптивность ресурсов к мобильным устройствам, повысились результаты мобильной выдачи.

Особого внимания заслуживает алгоритм «Палех», который презентовали в ноябре. Его основная суть состоит в сопоставлении смысла вопроса и страниц при помощи нейросетей - искусственного интеллекта, который моделирует работу человеческого мозга. Благодаря этому повысилась выдача по редким запросам. Изначально этот алгоритм работал исключительно с заголовками страниц, но, как говорят создатели, со временем научится «понимать» и сам текст. Работа алгоритма заключается в следующем:

- Система учитывает статистику соответствия запроса и заголовка, тем самым повышая точность поисковой выдачи.

- Работа с такими соответствиями получила название «семантический вектор». Такой подход к поисковому ранжированию помогает находить ответы на самые редкие запросы. Алгоритм, который научился понимать текст, может выдавать результаты в которых не будет ни единого похожего слова с запросом, но, тем не менее, они полностью соответствуют друг другу по содержанию.

Проще говоря, в "Яндексе" попытались создать «разумную» технологию, которая ищет ответы, опираясь не на ключевые слова, а на само содержание текста.

"Баден-Баден"

Новый алгоритм "Яндекса", вышедший в марте 2017 года, стал настоящим прорывом в системе поискового ранжирования. В поисковой выдаче на первое место начали выводить сайты с полезным, понятным и читабельным контентом. Основная алгоритма - предоставить пользователю не текст, соответствующий запросу, а нужную информацию.

За время работы «Баден-Баден» понизились в поисковой выдаче ресурсы с переоптимизированой и некачественной информацией. Эксперты были уверены, что упадут позиции интернет-магазинов, так как там слишком много повторяющихся слов и описаний товаров, что практически ничем не отличаются. Но разработчики алгоритма учитывали, что есть специфические темы, где повтор однокоренных слов неизбежен. Так какие же тексты попадают под санкции? Лучше это посмотреть на примере.

Текст, не соответствующий поисковому алгоритму

Раньше поисковые роботы выводили на первые позиции ресурсы, в которых были ключевые слова. Но тексты на таких сайтах зачастую выглядят как набор запросов, разбавленных «водой» некачественных текстов. И приведенный ниже пример - тому доказательство:

«Ежегодно Nike выпускает бесчисленное множество товаров для занятий спортом. Кроссовки, кеды, бутсы, костюм Nike, футболка Nike, шорты, спортивный костюм Nike, штаны, спортивные штаны Nike, футбольные мячи - эти и другие товары можно найти в любом фирменном магазине. Женские Nike, мужские и детские коллекции передают главную тему марки. Одежда Nike уникальна тем, что каждый товар передает настроение бренда».

Такие тексты не несут пользы, это не более чем шкатулки с ключевыми запросами. Вот с ними и борется новый алгоритм. Контент с низким качеством непременно потеряет свои позиции. Существуют три критерия низкокачественного контента:

- Отсутствие логики в тексте.

- ключевых слов.

- Присутствие в тексте неестественных фраз, которые появились из-за прямых вхождений ключевых слов.

Естественно, СЕО-оптимизацию никто не отменял, базовые принципы поисковых систем остаются прежними. Вот только подход, при котором на 1000 знаков приходится 15-20 ключевых запросов, уже давно устарел. Алгоритм "Баден-Баден" акцентирует внимание на качестве контента.

Поисковая выдача

Важное место в процессе нахождения информации занимает алгоритм выдачи. Выдача - это страница результатов, отвечающих определенному запросу. Алгоритм выдачи "Яндекса" построен таким образом, что может просчитать вероятность нахождения самого релевантного ответа и сформировать выдачу из десяти ресурсов. В случае когда запрос сложный, то в выдаче можно найти 15 ответов.

1. Язык ресурса |

2. Популярность темы и количество текста на каждой странице. |

3. Соотношения ключевых слов к общему количеству текста. |

4. Количество цитат и уровень уникальности контента |

5. Размер шрифта и его тип |

6. Число ссылок в тексте |

7. Соответствие ключевых слов разделу каталога, где зарегистрирован сайт. |

В действительности это работает так: если алгоритм «знаком» с запросом и по нему есть высокорелевантный ответ, то формируется выдача из десяти ответов. В случае, когда поисковая система не может найти таких ответов, в выдаче будет представлено 15 ссылок.

Вот, собственно, и все основы алгоритмов. Для того чтобы сайт хорошо себя чувствовал, при поисковой выдаче необходимо наполнить его качественным, информативным и читабельным контентом.

«Королев» — это не Минусинск, не Баден-Баден. Это не карательный фильтр. Он, кстати, не является надстройкой — является частью основного алгоритма Яндекса.

«Королев» работает на основе самообучаемой нейронной сети и затрагивает довольно редкие многословные запросы, в первую очередь информационные, которые направлены на уточнение смысла — низкочастотные (НЧ) и микроНЧ, в том числе голосовой поиск, разные естественные варианты запросов, типа «фильм, где мужик в разных ботинках».

Создан этот алгоритм был с целью улучшить качество выдачи по таким запросам, по аналогу с RankBrain Гугла, который давно с такой задачей хорошо справляется, да и сейчас, по первым замерам, работает по таким запросам лучше Яндекса.

До этого был и есть алгоритм «Палех», который уже начал искать по смыслу, но делал это в реальном времени и сопоставлял только смысл запроса и заголовка — Title страницы.

«Королев» анализирует не только Title, но и всю страницу в целом, показывает в выдачу даже те страницы, где нет упоминания слов из запроса, но по смыслу страница подходит. При этом он определяет суть страницы заранее, на этапе индексирования — в результате скорость и количество обрабатываемых страниц мощно увеличились.

Про «треть» тут может быть преувеличено — реальной доли запросов, которые затронет «Королев», пока еще никто не измерял.

Другие статьи про «Королев»:

Я много моментов тут еще не расписывала, про них стоит почитать в других статьях. Я выбрала тут только самые лучшие, действительно стоящие:

Мнения разных экспертов:

Дополнительные официальные источники:

Некоторые отрывки из мнений по ссылкам выше:

Дмитрий Шахов

«Королев» пройдет мимо поисковой оптимизации. По крайней мере, на данном этапе. Перед поиском стоит задача дать ответы по запросам, по которым нет документов с вхождениями. Поиск эту задачу решает. Hummingbird в Google, «Палех» и «Королев» в Яндексе. Запросы, по которым нет документов, не входят в зону интереса поисковой оптимизации. Именно поэтому там и нет документов.

Артур Латыпов

Многие ждали, что вскоре после «Палеха» появится алгоритм, который будет работать аналогично, но не по заголовкам, а по контенту. Пока не заметили скачков трафика на наблюдаемых сайтах, будем наблюдать внимательней и смотреть на развитие алгоритма в будущем. Интересно, раньше для улучшения ранжирования по большому количеству запросов, в том числе смежных, готовили SEO-тексты, они были у кого-то лучше, у кого-то хуже, кто-то их называл по-другому, но смысл от этого не менялся. Теперь за SEO тексты наказывают, а поиск будет ранжировать документы по смыслу.

Ожидаем, что в работе оптимизаторы будут больше использовать LSI при подготовке текстовой оптимизации.

Соответственно, будут развиваться SEO-сервисы. Напомню, что подготовка списка SEO-слов, терминов в тематике, смежных запросов для подготовки контента и оптимизации, используется специалистами уже несколько лет. Поэтому серьезных изменений в механике не произойдет, по крайней мере пока.

В итоге, больше внимания уделяем:

Качеству контента;

интенту запроса;

мониторингу выдачи.

И, конечно, всегда интересно после запуска нового алгоритма от Яндекса анализировать, что изменилось, и наблюдать, что будет дальше.

Дмитрий Севальнев

Фактически, с внедрением ряда новых факторов, которые учитывают:

смысловое соответствия пары запрос-документ (по всему тексту документа, а не только по Title, как ранее в алгоритме «Палех»),

качество ответа документа на схожие по смыслу поисковые запросы, –

не будет глобальных изменений для SEO-индустрии. Наиболее значимые изменения коснутся «длинного хвоста» запросов, под которые целенаправленно SEO-специалисты мало работают. Их много, они редкие и часто обеспечивают единичные заходы на сайт.

Может быть увеличена значимость ряда факторов, которые и так прорабатываются специалистами, с того момента как LSI стал «модной темой».

Олег Шестаков, CTO & Founder в Rush Analytics Russia

Анонс алгоритма «Королев» был, наверное, самым масштабным за все время с точки зрения шоу. С точки зрения технологий нельзя сказать, что это какой-то новый технологический прорыв. В чем смысл инновации: теперь нейронные сети Яндекса оценивают соответствие запрос-документ не просто с точки зрения вхождения запроса и его вариаций (леммы, частей запроса и т.д.) в текст документа, но и с точки зрения смысла запроса. Нейронная сеть, обученная на больших данных, теперь умеет определять релевантность документа запросу, даже если в документе нет вхождения слов запроса. На самом деле – это не новая технология – она же использовалась в алгоритме «Палех», правда он учитывал лишь заголовки документов. Т.е. настоящая инновация здесь в том, что инженеры Яндекса сумели масштабировать очень ресурсоемкий алгоритм на несколько порядков – теперь алгоритм может оценивать сотни тысяч документов, а не 150 строк текста как раньше.

Как алгоритм повлияет на рынок SEO?

— Глобально – никак. Это всего лишь часть алгоритма, а большинство других факторов как работали, так и будут работать. Данный алгоритм сильнее всего должен затронуть НЧ-запросы и часть СЧ-запросов.

— Придется уделять больше внимания качеству текстов. Теперь, чтобы вывести страницу в ТОП, текст страницы должен содержать как можно больше слов-синонимов и связанных с запросом слов, чтобы пройти по факторам нового алгоритма, т.к. он теперь учитывает именно такие слова, а не просто «прямые вхождения». Здесь нет никакой магии – нейросеть обучается учителями-асессорами и все равно работает с текстами реальных сайтов, находя связанные по смыслу слова. Значит можно провести похожий анализ и сделать экстракцию этих слова их документов ТОПа. Грамотные SEO-специалисты начали это делать уже несколько лет назад. Если простыми словами – тот же LSI, только в профиль.

— Рынок дешевого копирайтинга начнет схлопываться, и это очень хорошо. Задание на написание текста в формате «3 прямых вхождения, 4 разбавленных и длина 2500 символов» будет порождать тексты, которые будут слабо ранжироваться.

Теперь нужны тексты-истории. Мы как SEO-специалисты должны рассказать историю про продукт клиента во всех подробностях, описав продукт со всех сторон – при таком подходе будет физически сложно упустить важные тематичные запросу слова. Заметьте, что вебмастера, зарабатывающие на статейных сайтах, уже очень давно пишут тексты-истории даже о юристах по алиментам, с отличной версткой, раскрытием темы и points of interest. Что в результате? У них куча трафика и ТОПы, плюс тотальная победа над сухими сайтами юридических фирм.

Производство контента станет несколько дороже и профессиональнее. SEO-компании либо перестанут писать SEO-бред и построят взрослые контент-редакции внутри, или их клиенты потеряют позиции в поиске. Яндекса вчера толсто на это намекнул.

Александр Алаев

«Королев» со всем не про SEO. Цель SEO – работа с запросами, которые спрашивают много раз и смысл их понятен, а релевантных ответов тысячи. Задача поисковика в коммерческом сегменте – найти лучших кандидатов по коммерческим критериям, а не искать смыслы. Именно поэтому коммерческая выдача не изменится, по крайней мере сколько-либо заметно.

А вот владельцам информационных ресурсов еще раз стоит обратить внимание на качество контента, ориентировать свои публикации не под поисковые запросы, а под интересы пользователей, писать человеческим простым языком.

Все мои проекты, кроме этого SEO-блога:

ТОП База - качественная база для полуавтоматической регистрации с Allsubmitter или для полностью ручного размещения - для самостоятельного бесплатного продвижения любого сайта, привлечения целевых посетителей на сайт, поднятия продаж, естественного разбавления ссылочного профиля. Базу собираю и обновляю 10 лет. Есть все виды сайтов, все тематики и регионы.

SEO-Topshop - SEO-софт со СКИДКАМИ, по выгодным условиям, новости SEO-сервисов, баз, руководств. Включая Xrumer по самым выгодным условиям и с бесплатным обучением, Zennoposter, Zebroid и разные другие.

Мои бесплатные комплексные курсы по SEO

- 20 подробных уроков в формате PDF.

- каталоги сайтов, статей, пресс-релизовые сайты, доски объявлений, каталоги фирм, форумы, соцсети, блоговые системы и прочее.

"Приближаясь.." - мой блог на тему саморазвития, психологии, отношений, личной эффективности

Алгоритм ранжирования сайтов в Яндексе непрерывно подвергается изменениям и дополнениям: добавляют новый функционал, обновляют ограничения, фильтры… Очень долгое время учет всех алгоритмов ранжирования вели только внутри компании и, когда его резко обновляли, пользователи негодовали и, откровенно говоря, мало что понимали.

Занимало не мало времени на исследования алгоритмов ранжирования Яндекса, поиск ответов на тему фильтров и как не попасть в «черный список». Сейчас все чуть проще, но не на столько, чтобы оставить без внимания разбор принципа работы Яндекса.

Алгоритмы Яндекса имеют уже довольно долгую историю создания и становления, еще с далекого 1997 года. С того времени Яндекс изменился и появлялись все новые алгоритмы и новые фильтры. Начнем свой «разбор полетов», пожалуй, с самых «свежих» алгоритмов.

Новый алгоритм Яндекса «Баден-Баден». 2017 год

Яндекс новый алгоритм определения текстового спама под названием «Баден-Баден».

Алгоритм создан для борьбы с «накруткой» релевантности путём написания бесполезных для пользователя и «переоптимизированных» текстов (с большим количеством вхождений ключей).

Как говорится в блоге Яндекса, алгоритм, определяющий текстовый спам, существенно изменен и улучшен. Сами авторы публикации утверждают, что данный алгоритм «является частью общего алгоритма ранжирования, результатом его работы может стать ухудшение позиций переоптимизированных страниц в результатах поиска». И что же это могло бы означать?

Во-первых, если его «переработали и улучшили», то, скорее всего, этот алгоритм создан для замены уже привычных фильтров «переспам» и «переоптимизация». А если он действительно «является частью общего алгоритма ранжирования», то и диагностировать наличие «штрафов», накладываемых данным алгоритмом, ясное дело, будет труднее.

Новый алгоритм Яндекса 2016 год. «Палех»

Алгоритм будет стараться сопоставить смыслы запроса с помощью нейросетей, а не просто сопоставлять ключевики, как это делалось обычно. Это делалось для того, чтобы обеспечить наилучшую выдачу по редчайшим запросам пользователя. Новый алгоритм основан на нейронных сетях и помогает Яндексу находить соответствие между поисковым запросом и заголовками страниц, даже если у них нет общих ключевых фраз. Чтобы понять, что фактически произошло, несколько цитат из официального блога компании Яндекс:

В нашем случае мы имеем дело не с картинками, а с текстами - это тексты поисковых запросов и заголовков веб-страниц, - но обучение проходит по той же схеме: на положительных и отрицательных примерах. Каждый пример - это пара «запрос - заголовок». Подобрать примеры можно с помощью накопленной поиском статистики. Обучаясь на поведении пользователей, нейросеть начинает «понимать» смысловое соответствие между запросом и заголовками страниц.

Семантический вектор применяется не только в поиске Яндекса, но и в других сервисах - например, в Картинках. Там он помогает находить в интернете изображения, которые наиболее точно соответствуют текстовому запросу.

Технология семантических векторов обладает огромным потенциалом. Например, переводить в такие векторы можно не только заголовки, но и полные тексты документов - это позволит ещё точнее сопоставлять запросы и веб-страницы.

Внедрение нового алгоритма Яндекс – это еще один значимый аргумент в пользу продвижения по низкочастотным запросам для тех, кто занимается развитием и продвижением сайтов. Перспективы развития нового алгоритма Яндекса лишь подтверждают верность выбранного направления, ведь в недалеком будущем речь пойдет об улучшенном распознавании не только заголовков, но и всего текстового документа в целом (!).

В Яндексе график частотного распределения представляют в виде птицы, у которой есть клюв, туловище и длинный хвост, характерный жар-птице

- Клюв - самые высокочастотные запросы. Список таких запросов не очень большой, но их задают очень-очень часто.

- Туловище -среднечастотные запросы.

- Хвост - низкочастотные и микронизкочастотные запросы. «По отдельности они встречаются редко, но вместе составляют существенную часть поискового потока, и поэтому складываются в длинный хвост».

Такой хвост принадлежит птице, которая довольно часто фигурирует на палехской миниатюре. Именно поэтому алгоритм получил название «Палех».

Все алгоритмы Яндекса. (2007-2017 года)

- 2 июля 2007 год . «Версия 7». Новая формула ранжирования, повышение числа факторов, анонс состоялся только на searchengines.guru .

- 20 декабря 2007 год . 17 января 2008 год. «Версия 8» и «Восьмерка SP1». Авторитетные ресурсы получили значимый плюс в ранжировании, внедрение фильтрации «прогонов» для накрутки ссылочных факторов.

- 16 мая, 2 июля 2008 год . «Магадан» (Fast Rank для быстрого подбора претендентов, мягкость, расширение базы аббревиатур и синонимов, расширенные классификаторы документов), «Магадан 2.0» (уникальность контента, новые классификаторы запросов пользователей и документов).

- 11 сентября 2008 год . «Находка» (учёт стоп-слов в поисковом запросе, новый подход к машинному обучению, тезаурус).

- 10 апреля, 24 июня, 20 августа, 31 августа, 23 сентября, 28 сентября 2009 год.

«Арзамас / Анадырь» (учёт региона пользователя, снятие омонимии), «Арзамас 1.1» (новая региональная формула для ряда городов, кроме Москвы, Санкт-Петербурга и Екатеринбурга), «Арзамас 1.2» (новый классификатор геозависимости запросов), «Арзамас+16» (независимые формулы для 16 регионов России), «Арзамас 1.5» (новая общая формула для геонезависимых запросов), «Арзамас 1.5 SP1» (улучшенная региональная формула для геозависимых запросов). - 17 ноября 2009 год . «Снежинск» (запуск технологии машинного обучения MatrixNet, кратный рост числа факторов ранжирования, 19 локальных формул для крупнейших регионов России, сильнейшие изменения выдачи).

- 22 декабря 2009 год. 10 марта 2010 год . «Конаково» (неофициальное название, но далее будет именно Обнинск, свои формулы для 1250 городов по всей России), «Конаково 1.1» («Снежинск 1.1») - обновление формулы для геонезависимых запросов.

- 13 сентября 2010 год . «Обнинск» (перенастройка формулы, повышение производительности, новые факторы и ранжирование для геонезависимых запросов, доля которых в потоке составляет более 70%).

- 15 декабря 2010 год . «Краснодар» (технология «Спектр» и повышение разнообразия выдачи, разложение запроса пользователя на интенты), далее: повышение локализации выдачи по геозависимым запросам, независимые формулы для 1250 городов России.

- 17 августа 2011 год . «Рейкьявик» (учёт языковых предпочтений пользователей, первый шаг персонализации выдачи).

- 12 декабря 2012 год . «Калининград» (существенная персонализация выдачи: подсказки, учёт долгосрочных интересов пользователя, повышение релевантности для «любимых» сайтов).

- 30 мая 2013 год . «Дублин» (дальнейшая персонализация выдачи: учёт сиюминутных интересов пользователей, подстройка результатов выдачи под пользователя прямо во время поисковой сессии).

- 12 марта 2014 год . «Началово»*, «Без ссылок» (отмена учета ссылок / ряда ссылочных факторов в ранжировании для групп коммерческих запросов в Московском регионе).

- 5 июня 2014 год . «Одесса»*, «Острова» (новый «островной» дизайн выдачи и сервисов, внедрение интерактивных ответов, в дальнейшем эксперимент был признан неуспешным и завершен).

- 1 апреля 2015 год . «Амстердам»*, «Объектный ответ» (дополнительная карточка с общей информацией о предмете запроса справа от результатов выдачи, Яндекс классифицировал и хранил в базе десятки миллионов различных объектов поиска).

- 15 мая 2015 год . «Минусинск» (понижение в ранжировании сайтов с избыточным числом и долей SEO-ссылок в ссылочном профиле, массовое снятие SEO-ссылок, дальнейшее возвращение учёта ссылочных факторов в ранжировании по всем запросам в Московском регионе).

- 14 сентября 2015 год (± 3 месяца). «Киров»*, «Многорукие Бандиты Яндекса» (рандомизированная добавка к численному значению релевантности ряда документов с оценкой «Rel+», с целью сбора дополнительной поведенческой информации в Московском регионе, в дальнейшем - рандомизация была внедрена и в регионах России).

- 2 февраля 2016 год

. «Владивосток» (учёт адаптированности сайта к просмотру с переносных устройств, повышение в результатах мобильной выдачи адаптированных проектов).

* - неофициальные названия алгоритмов, города подобраны на усмотрение автора с целью соблюдение очередности.

И завершающими на данный момент (мы же развиваемся) алгоритмами являются вышеописанные алгоритмы с эпичными и неординарными названиями «Палех» и «Баден-Баден».

Все фильтры Яндекса и их виды.

В Яндексе множество фильтров, которые могут примениться как к сайту в целом, так и на отдельные его страницы в частности. К сожалению, не всегда понятно, какой именно из фильтров из их множества и за какие нарушения наложен на сайт – сейчас любое малейшее несоответствие при использовании стандартных методов продвижения может быть распознан как «переспам». Итог: пессимизация.

Все фильтры Яндекса (в зависимости от их появления) можно разделить на 3 вида:

— Предфильтры:

дисконтируют значение каких-либо факторов еще до того, как рассчитана релевантность сайта. Действие предфильтров можно заметить не сразу – обычно оно проявляется в «залипании» сайта на каких-то местах (сайт дошел до 2 страницы и не двигается дальше, несмотря на наращивание ссылочной массы, например).

— Постфильтры:

обнуляют значение того или иного фактора уже после того, как рассчитана релевантность сайта. Не заметить этот тип фильтров сложно – именно они проявляются в резком падении позиций и трафика с Яндекса. Практически все фильтры за накрутку внутренних факторов можно отнести к постфильтрам.

– Фильтрация перед выдачей:

это когда релевантность сайта рассчитана, но по каким-то причинам в выдачу он не допускается.

— Бан

: Редко, но до сих пор встречается полное исключение сайта из выдачи за грубые нарушения поисковой лицензии.

Судя по всему Яндекс довольно требователен к качеству сайтов и при каждом подходящем случае напоминает нам о своей официальной позиции – развивай свой сайт, ориентируйся на «живого» пользователя и если оценка сайта от Яндекса будет «на отлично» — твой сайт не оставят без внимания. Оптимизируйте сайт так, чтобы оптимизация не вредила, а, наоборот, помогала юзерам ориентироваться на вашем сайте.

Сегодня был запущен новый алгоритм поиска в Яндексе, который с помощью нейронной сети сопоставляет смысл запросов и вебстраниц - это позволяет Яндексу точнее отвечать на сложные пользовательские запросы и выдавать более релевантные результаты. Как мы писали ранее - алгоритм базируется на категорийном бустинге: то есть способен учитывать так называемые категориальные признаки — признаки, которые принимают одно из конечного количества значений.

Запуск нового алгоритма "Королев"

Презентация нового алгоритма поиска проводилась в Московском планетарии, что как бы намекает на "изменения космического масштаба". Ведущие презентации прямо на сцене нажали на "красную кнопку", ознаменовав тем самым запуск нового алгоритма, название которого - "Королев".

Искусственный интеллект все ближе к человеку

Первый шаг к поиску по смыслу Яндекс сделал в прошлом году, когда был представлен поисковый алгоритм «Палех». В его основе лежит нейронная сеть. Нейросети показывают отличные результаты в задачах, с которыми люди традиционно справлялись лучше машин: скажем, распознавание речи или объектов на изображениях.

Запуская «Палех», Яндекс научил нейронную сеть преобразовывать поисковые запросы и заголовки веб-страниц в группы чисел — семантические векторы. Важное свойство таких векторов состоит в том, что их можно сравнивать друг с другом: чем сильнее будет сходство, тем ближе друг к другу по смыслу запрос и заголовок.

Как работает новый алгоритм «Королёв»

Поисковый алгоритм «Королёв» сравнивает семантические векторы поисковых запросов и веб-страниц целиком — а не только их заголовков. Как и в случае с «Палехом», тексты веб-страниц в семантические векторы преобразует нейросеть. «Королёв» высчитывает векторы страниц не в режиме реального времени, а заранее, на этапе индексирования. Когда вы задаете запрос, алгоритм сравнивает вектор запроса с уже известными ему векторами страниц.

Данная схема позволяет начать подбор документов, соответствующих запросу по смыслу, еще на ранних стадиях ранжирования. В алгоритме «Палех» смысловой анализ - один из завершающих этапов, через который проходят всего 150 документов. В «Королёве» смысловой анализ производится для 200 тысяч документов - в тысячу с лишним раз больше! При этом - «Королёв» не только сравнивает текст веб-страницы с запросом, но и обращает внимание на другие запросы, по которым пользователи переходят на страницу из поиска, что позволяет установить дополнительные смысловые связи между запросами и страницей.

Кто обучает нейронную сеть

Нейронная сеть алгоритма «Королёв» обучается на обезличенной поисковой статистике. Системы сбора статистики учитывают - на какие страницы пользователи переходят по различным запросам и сколько времени проводят на них. Если пользователь открыл веб-страницу и провел на ней много времени - можно предположить, что он получил ответ на свой вопрос - то есть страница хорошо отвечает на его запрос.

Чтобы поиск развивался, люди должны постоянно давать оценку его работе. Еще не так давно оценкой поиска занимались только сотрудники Яндекса — асессоры . Но с развитием технологий и проектов - количества асессоров стало катастрофически нехватать. Поэтому Яндекс решил привлечь к этому всех желающих и запустил сервис Яндекс.Толока.

Сейчас в сервисе зарегистрировано более миллиона пользователей: они анализируют качество поиска и участвуют в улучшении других сервисов Яндекса. За два с лишним года существования сервиса толокеры дали около двух миллиардов оценок.

В основе современного поиска лежат очень сложные алгоритмы, которые придумывают разработчики, а учат их — миллионы пользователей Яндекса. Любой запрос — это анонимный сигнал, который помогает машине всё лучше понимать людей.

Как Яндекс отправил котов в космос - смотрите в записи презентации из Московского планетария.

Запись презентации Янедкса

Яндекс запустил новый алгоритм ранжирования - «Королев». Теперь поисковая система сопоставляет смыслы поискового запроса и страницы. Это очень удобно для пользователей. Однако что новый алгоритм означает для оптимизаторов и владельцев сайтов, как изменится продвижение и стоит ли ждать изменения трафика.

Как никогда весь «сеошный» мир ждал запуска нового алгоритма ранжирования, анонсированного на 22 августа 2017 года. Ещё бы, подобные анонсы – вещь для Яндекса абсолютно нетипичная, обычно они предпочитают не распространяться о своих планах, и сообщают об очередном релизе алгоритма ранжирования постфактум.

22 августа 2017 года Яндекс запустил новую версию поиска. В её основе лежит поисковый алгоритм «Королёв» (с 2008-го года новые алгоритмы ранжирования в Яндексе называют в честь городов). Алгоритм с помощью нейронной сети сопоставляет смысл запросов и веб-страниц - это позволяет Яндексу точнее отвечать на сложные запросы. Для обучения новой версии поиска используются поисковая статистика и оценки миллионов людей. Таким образом, вклад в развитие поиска вносят не только разработчики, но и все пользователи Яндекса.

Область применения нового алгоритма практически не затрагивает традиционные сеошные сферы интересов, в первую очередь к которым можно отнести коммерческую выдачу. «Королёв» оказался логическим продолжением алгоритма «Палех» и призван обслуживать длинный хвост микрочастотных запросов, как правило, задаваемых на естественном языке. Особенностью таких запросов является то, что релевантные им документы могут не содержать многих из слов, входящих в запрос. Это ставит в тупик традиционные алгоритмы ранжирования, основанные на текстовой релевантности.

Решение найдено в виде использования нейросетей, которые обучаются в том числе и на поведении пользователей. Поэтому новый алгоритм Яндекса работает на основе нейронной сети. Он обучается на примерах запросов пользователей, и подбирает ответы исходя из смысла текста на странице. Это означает, в частности, что он будет гораздо эффективнее работать с нестандартными запросами, когда пользователи сами не уверены, как называется то, что они хотят найти. Здесь многое упирается в вычислительные мощности.

Вообще подобный подход к решению задачи ранжирования длинного микрочастотного хвоста запросов не нов. Еще в 2015-м году стало известно о технологии, применяемой поисковой системой Google для поиска ответов на многословные запросы, заданные на естественном языке – RankBrain. Эта технология, так же основанная на машинном обучении, позволяет распознавать наиболее значимые слова в запросах, и анализировать контекст, в котором осуществляется поиск. Что позволяет находить релевантные документы, которые не содержат всех слов запроса.

Кроме того, алгоритм работает и с картинками. Он анализирует содержание изображения и подбирает необходимый вариант, исходя из него, а не только из описания в тегах или окружающего его текста.

Впрочем, длинный хвост микрочастотных многословных запросов на естественном языке вполне может быть интересен «выжигателям» информационной семантики – создателям так называемых инфосайтов «на все случаи жизни». В общем-то, они и так стараются под как можно большее количество известных им запросов, которые удается заполучить с помощью различных методов сбора семантики, организовать точное вхождение в свои тексты. Там же, где точных вхождений не будет, т.е. для запросов, которые не всосал «семантический пылесос» создателей инфосайтов или для которых им не удалось обеспечить точных вхождений в контент, и начинается вотчина «Королёва», который призван искать соответствия между запросами и ответами в том случае, когда между ними мало пересечений по ключевым словам. В таких случаях «Королёв» несомненно повысит требования к качеству контента, и реально интересные читабельные статьи будут еще больше выигрывать у сборников вхождений ключевых фраз, разбавленных водой, т.к. именно в таких статьях могут содержаться полезные для нового алгоритма сигналы. Ну, а всем остальным сеошникам действительно можно расслабиться – очередная порка откладывается. Жертв и разрушений нет.

Запуская «Палех», Яндекс научил нейронную сеть преобразовывать поисковые запросы и заголовки веб-страниц в группы чисел - семантические векторы.

Важное свойство таких векторов состоит в том, что их можно сравнивать друг с другом: чем сильнее будет сходство, тем ближе друг к другу по смыслу запрос и заголовок.

Чем он отличается от «Палеха»?

Основным отличием нового алгоритма, помимо улучшения технической реализации, является возможность распознавать схожие «смыслы» по всему документу, а не только по заголовку (Title), который появляется в окне браузера.

Как работает алгоритм «Королёв»

Поисковый алгоритм «Королёв» сравнивает семантические векторы поисковых запросов и веб-страниц целиком - а не только их заголовки. Это позволяет выйти на новый уровень понимания смысла.

Как и в случае с «Палехом», тексты веб-страниц в семантические векторы преобразует нейросеть. Эта операция требует много вычислительных ресурсов. Поэтому «Королёв» высчитывает векторы страниц не в режиме реального времени, а заранее, на этапе индексирования.

Когда человек задаёт запрос, алгоритм сравнивает вектор запроса с уже известными ему векторами страниц.

Эффект «Королёва»

Умение понимать смысл особенно полезно при обработке редких и необычных запросов - когда люди пытаются описать своими словами свойства того или иного объекта и ожидают, что поиск подскажет его название.

Такая схема позволяет начать подбор веб-страниц, соответствующих запросу по смыслу, на ранних стадиях ранжирования. В «Палехе» смысловой анализ - один из завершающих этапов: через него проходят всего 150 документов. В «Королёве» он производится для 200 000 документов.

Кроме того, новый алгоритм не только сравнивает текст веб-страницы с поисковым запросом, но и обращает внимание на другие запросы, по которым люди приходят на эту страницу.

Так можно установить дополнительные смысловые связи.

Люди учат машины

Использование машинного обучения, а особенно нейросетей, рано или поздно позволит научить поиск оперировать смыслами на уровне человека. Чтобы машина поняла, как решать ту или иную задачу, необходимо показать ей огромное количество примеров: положительных и отрицательных. Такие примеры дают пользователи Яндекса.

Нейронная сеть, которую использует алгоритм «Королёв», обучается на обезличенной поисковой статистике. Системы сбора статистики учитывают, на какие страницы пользователи переходят по тем или иным запросам и сколько времени они там проводят.

Если человек открыл веб-страницу и «завис» там надолго, вероятно, он нашёл то, что искал, - то есть страница хорошо отвечает на его запрос. Это положительный пример.

Подобрать отрицательные примеры гораздо легче: достаточно взять запрос и любую случайную веб-страницу.Статистика, которая используется для обучения алгоритма, обезличена

В помощи людей нуждается и Матрикснет, который строит формулу ранжирования.

Толока

Чтобы поиск развивался, люди должны постоянно давать оценку его работе. Когда-то выставлением оценок занимались только сотрудники Яндекса - так называемые асессоры. Но чем больше оценок, тем лучше - поэтому Яндекс привлек к этому всех желающих и запустили сервис Яндекс.Толока . Сейчас там зарегистрировано более миллиона пользователей: они анализируют качество поиска и участвуют в улучшении других сервисов Яндекса. Задания на Толоке оплачиваются - сумма, которую можно заработать, указана рядом с заданием. За два с лишним года существования сервиса толокеры дали около двух миллиардов оценок.

В основе современного поиска лежат сложные алгоритмы. Алгоритмы придумывают разработчики, а учат - миллионы пользователей Яндекса. Любой запрос - это анонимный сигнал, который помогает машине всё лучше понимать людей. Новый поиск - это поиск, который мы делаем вместе.