Поисковые роботы их функция и логика работы. Поисковый робот

Всем привет! Сегодня я вам расскажу о том, как работает поисковый робот. Также вы узнаете, что такое поисковые роботы. Их назначение и особенность.

Для начала, начну, пожалуй, с определения.

Поисковый робот – это своего рода программа, которая посещает гипертекстовые ссылки, извлекая из того или иного ресурса все последующие документы занося их в индекс поисковой системы.

У каждого поискового робота, есть свое уникальное название – Краулер, Паук и т.д.

Что делает поисковый робот

Как я уже говорил, каждый робот имеет свое уникальное имя и соответственно, каждый выполняет свою определенную работу, или скажем так, предназначение.

Давайте рассмотрим, какие функции они выполняют:

- Запрос на доступ к сайту;

- Запрос для обработки и извлечению страниц;

- Запрос на анализ контента;

- Поиск ссылок;

- Мониторинг обновлений;

- Запрос к данным RSS (сбор контента);

- Индексация.

Например, у Яндекса существует несколько роботов, которые отдельно индексируют, анализируют, проводят сбор информации о следующих данных:

- Видео;

- Картинки;

- Зеркало сайта;

- Xml-файлы;

- Файл robots.txt;

- Комментарии;

Вообще, по сути, поисковый робот всего-навсего посещает интернет ресурсы, собирая необходимые данные, которые он потом передает индексатору поисковой машины.

Именно индексатор поисковой машины обрабатывает полученные данные, и выстраивает индекс поисковой системы должным образом. Я бы даже сказал, что робот – это «курьер», который всего лишь собирает информацию.

Как ведут себя роботы и как ими управлять

Отличия поведения робота от простого пользователя на сайте, заключается в следующем:

1. Во первых, это касается управляемости. В первую очередь, робот запрашивает с вашего хостинга () файл robots.txt, в котором указанно, что можно индексировать, а что нельзя.

2. Особенное отличие робота – это скорость. Между каждыми запросами, которые относятся к двум разным документам, их скорость составляет секунды, а то и доли секунды.

Даже для этого, есть специальное правило, которое можно указать в файле robots.txt, чтобы роботу поисковых систем поставить ограничение к запросам, тем самым уменьшив нагрузку на блог.

3. Также, хотелось бы отметить их непредсказуемость. Когда робот посещает ваш блог, его действия невозможно отследить, невозможно узнать, откуда он пришел т.п. Он действует по своему принципу, и в том порядке, как построена очередь индексации.

4. И еще один момент, это когда робот, в первую очередь обращает внимание на гипертекстовые и текстовые документы, а не на всякие файлы, касающиеся оформления CSS и т.п.

Хотите посмотреть, как выглядит страница вашего блога в глазах поискового робота? Просто-напросто, отключите в своем браузере отображение Flash, картинок и стилей оформления.

И вы увидите, что любой поисковый робот заносит в индекс, только HTML-код страницы, без всяких картинок и прочего содержания.

А теперь, настало время поговорить, как ими управлять. Как я уже говорил ранее, управлять роботами можно через специальный файл robots.txt, в котором можно прописывать нужные нам инструкции и исключения, чтобы контролировать их поведение на своем блоге.

К этому моменту, нужно отнестись очень внимательно! Так, как робот ПС – это очень важная часть, которая непосредственно влияет на судьбу вашего блога, это касается в частности его индексации, ранжирования, и еще много важных моментов.

Запомните, ваш блог должен нравиться поисковым системам! О том, как правильно настроить файл robots.txt , я расскажу в следующей статье. А также рекомендую вам прочитать статьи про то, что такое и конверсия сайта. На сегодня у меня все.

Некоторые роботы могут маскироваться под роботов Яндекса путем указания соответствующего User agent. Вы можете проверить, что робот является тем, за кого себя выдает используя идентификацию, основанную на обратных DNS запросах (reverse DNS lookup).

Для этого необходимо выполнить следующее:

Для интересующего User-agent определите IP-адрес по логам вашего сервера. Все роботы Яндекса представляются с помощью заданных User agent .

По полученному IP-адресу определите доменное имя хоста, используя обратный DNS запрос.

После определения имени хоста, Вы можете проверить, принадлежит ли он Яндексу. Имена всех роботов Яндекса заканчиваются на "yandex.ru", "yandex.net" или "yandex.com". Если имя хоста имеет другое окончание, это означает, что робот не принадлежит Яндексу.

Напоследок удостоверьтесь в корректности полученного имени. Для этого нужно использовать прямой DNS запрос (forward DNS lookup), чтобы получить IP-адрес, соответствующий имени хоста. Он должен совпадать с IP-адресом, использованным при обратном DNS запросе. Если IP-адреса не совпадают, это означает, что полученное имя хоста поддельное.

Роботы Яндекса в логах сервера

Вопросы и ответы

Как оградиться от мошеннических роботов, представляющихся роботами Яндекса

Если вы хотите оградиться от мошеннических роботов, представляющихся роботами Яндекса, Вы можете использовать фильтрацию, основанную на обратных DNS запросах . Такая схема более предпочтительна по сравнению с управлением доступом на основе IP-адресов, так как она устойчива к изменениям внутренних сетей Яндекса.

Объем трафика между моим веб-сервером и вашим роботом слишком большой. Существует ли поддержка скачивания страниц в сжатом виде?

Да, существует. Поисковый робот Яндекса при каждом запросе страницы говорит: «Accept-Encoding: gzip,deflate» . Это означает, что настроив соответствующим образом свой веб-сервер, вы сможете снизить объем передаваемого трафика между ним и нашим роботом. Однако следует иметь в виду - передача контента в сжатом виде увеличивает нагрузку на CPU вашего сервера, и, если он сильно загружен, могут возникнуть проблемы. Поддерживая gzip и deflate , робот придерживается стандарта rfc2616 ,

Поисковый робот (бот, паук, spider, crawler) — это специальная программа поисковика, предназначенная для сканирования сайтов в сети Интернет.

Многие не знают, что сканирующие боты просто собирают и сохраняют информацию. Они не занимаются ее обработкой. Это делают другие программы.

Если у вас есть желание посмотреть на сайт глазами поискового робота, то можно это сделать через панель вебмастера.

Посмотреть как Google можно через панель вебмастера. Там нужно добавить свой сайт и потом можно будет посмотреть на странице:

https://www.google.com/webmasters/tools/googlebot-fetch?hl=ru

Посмотреть как Яндекс можно через сохраненную копию страницы. Для этого находим нужную страницу в поиске Яндекса, жмем «сохраненная копия» и дальше «посмотреть текстовую версию».

Ниже приведу список поисковых роботов, которые ходят по нашим с вами сайтам. Одни из них индексируют сайты , другие следят за контекстной рекламой. Есть специализированные роботы, которые занимаются определенными узкими задачами. Например, индексируют картинки или новости.

Зная «в лицо» робота, можно запретить или разрешить ему ползать по сайту, тем самым можно снизить нагрузку на сервер. Ну или защитить свою информацию от попадания в сеть.

Поисковые роботы Яндекса

У поисковой системы Яндекс десятка полтора известных нам поисковых роботов. Список ботов, который мне удалось раскопать, в том числе и из официального хелпа, ниже.

YandexBot — основной индексирующий робот;

YandexMedia — робот, индексирующий мультимедийные данные;

YandexImages — индексатор Яндекс.Картинок;

YandexCatalog — «простукивалка» Яндекс.Каталога, используется для временного снятия с публикации недоступных сайтов в Каталоге;

YaDirectFetcher — робот Яндекс.Директа;

YandexBlogs — робот поиска по блогам, индексирующий посты и комментарии;

YandexNews — робот Яндекс.Новостей;

YandexWebmaster – приходит придобавлении сайта через форума AddURL;

YandexPagechecker — валидатор микроразметки;

YandexFavicons — индексатор фавиконок

YandexMetrika — робот Яндекс.Метрики;

YandexMarket — робот Яндекс.Маркета;

YandexCalendar — робот Яндекс.Календаря.

Поисковые роботы (боты) Google

Googlebot — основной индексирующий робот;

Googlebot Nes — индексатор новостей;

Googlebot Images — индексатор картинок;

Googlebot Video — робот для видео данных;

Google Mobile — индексатор мобильного контента;

Google Mobile AdSense — робот мобильного AdSense

Google AdSense — робот AdSense

Google AdsBot – бот проверки качества целевой страницы

Mediapartners-Google — робот AdSense

Роботы других поисковых систем

Так же, в логах своего сайта, вы можете наткнуться на некоторых роботов других поисковиков.

Рамблер — StackRambler

Мэйл.ру — Mail.Ru

Yahoo! — Slurp (или Yahoo! Slurp)

AOL — Slurp

MSN — MSNBot

Live — MSNBot

Ask — Teoma

Alexa — ia_archiver

Lycos — Lycos

Aport — Aport

Вебальта — WebAlta (WebAlta Crawler/2.0)

Кроме ботов поисковиков, по сайтам бегает огромная армия всяких левых пауков. Это различные парсеры, которые собирают информацию с сайтов, как правило, в корыстных целях их создателей.

Одни воруют контент, другие картинки, третьи взламывают сайты и расставляют втихаря ссылки. Если вы заметили, что подобный парсер присосался к вашему сайту — закройте ему доступ всеми возможными способами, в том числе и через

Роботы поисковой системы, иногда их называют «пауки» или «кроулеры» (crawler) — это программные модули, занимающиеся поиском web-страниц. Как они работают? Что же они делают в действительности? Почему они важны?

Учитывая весь шум вокруг поисковой оптимизации и индексных баз данных поисковиков, вы, наверное думаете, что роботы должно быть великие и могущественные существа. Неправда. Роботы поисковика обладают лишь базовыми функциями, похожими на те, которыми обладали одни из первых броузеров, в отношении того, какую информацию они могут распознать на сайте. Как и ранние броузеры, роботы попросту не могут делать определенные вещи. Роботы не понимают фреймов, Flash анимаций, изображений или JavaScript. Они не могут зайти в разделы, защищенные паролем и не могут нажимать на все те кнопочки, которые есть на сайте. Они могут «заткнуться» в процессе индексирования динамических адресов URL и работать очень медленно, вплоть до остановки и безсилием над JavaScript-навигацией.

Как работают роботы поисковой машины?

Поисковые роботы стоит воспринимать, как программы автоматизированного получения данных, путешествующие по сети в поисках информации и ссылок на информацию.

Когда, зайдя на страницу «Submit a URL», вы регистрируете очередную web-страницу в поисковике — в очередь для просмотра сайтов роботом добавляется новый URL. Даже если вы не регистрируете страницу, множество роботов найдет ваш сайт, поскольку существуют ссылки из других сайтов, ссылающиеся на ваш. Вот одна из причин, почему важно строить ссылочную популярность и размещать ссылки на других тематических ресурсах.

Прийдя на ваш сайт, роботы сначала проверяют, есть ли файл robots.txt. Этот файл сообщает роботам, какие разделы вашего сайта не подлежат индексации. Обычно это могут быть директории, содержащие файлы, которыми робот не интересуется или ему не следовало бы знать.

Роботы хранят и собирают ссылки с каждой страницы, которую они посещают, а позже проходят по этим ссылкам на другие страницы. Вся всемирная сеть построена из ссылок. Начальная идея создания Интернет сети была в том, что бы была возможность перемещаться по ссылкам от одного места к другому. Вот так перемещаются и роботы.

«Остроумность» в отношении индексирования страниц в реальном режиме времени зависит от инженеров поисковых машин, которые изобрели методы, используемые для оценки информации, получаемой роботами поисковика. Будучи внедрена в базу данных поисковой машины, информация доступна пользователям, которые осуществляют поиск. Когда пользователь поисковой машины вводит поисковый запрос, производится ряд быстрых вычислений для уверенности в том, что выдается действительно правильный набор сайтов для наиболее релевантного ответа.

Вы можете просмотреть, какие страницы вашего сайта уже посетил поисковый робот, руководствуясь лог-файлами сервера, или результатами статистической обработки лог-файла. Идентифицируя роботов, вы увидите, когда они посетили ваш сайт, какие страницы и как часто. Некоторые роботы легко идентифицируются по своим именам, как Google’s «Googlebot». Другие более скрытые, как, например, Inktomi’s «Slurp». Другие роботы так же могут встречаться в логах и не исключено, что вы не сможете сразу их идентифицировать; некоторые из них могут даже оказаться броузерами, которыми управляют люди.

Помимо идентификации уникальных поисковых роботов и подсчета количества их визитов, статистика также может показать вам агрессивных, поглощающих ширину катала пропускания роботов или роботов, нежелательных для посещения вашего сайта.

Как они читают страницы вашего web-сайта?

Когда поисковой робот посещает страницу, он просматривает ее видимый текст, содержание различных тегов в исходном коде вашей страницы (title tag, meta tags, и т.д.), а так же гиперссылки на странице. Судя по словам ссылок, поисковая машина решает, о чем страница. Есть много факторов, используемых для вычисления ключевых моментов страницы «играющих роль». Каждая поисковая машина имеет свой собственный алгоритм для оценки и обработки информации. В зависимости от того, как робот настроен, информация индексируется, а затем доставляется в базу данных поисковой системы.

После этого, информация, доставленная в индексные базы данных поисковой системы, становится частью поисковика и процесса ранжирования в базе. Когда посетитель существляет запрос, поисковик просматривает всю базу данных для выдачи конечного списка, релевантного поисковому запросу.

Базы данных поисковых систем подвергаются тщательной обработке и приведению в соответствие. Если вы уже попали в базу данных, роботы будут навещать вас периодически для сбора любых изменений на страницах и уверенности в том, что обладают самой последней информацией. Количество посещений зависит от установок поисковой машины, которые могут варьироваться от ее вида и назначения.

Иногда поисковые роботы не в состоянии проиндексировать web-сайт. Если ваш сайт упал или на сайт идет большое количество посетителей, робот может быть безсилен в попытках его индексации. Когда такое происходит, сайт не может быть переиндексирован, что зависит от частоты его посещения роботом. В большинстве случаев, роботы, которые не смогли достичь ваших страниц, попытаются позже, в надежде на то, что ваш сайт в ближайшее время будет доступен.

Многие поисковые роботы не могут быть идентифицированы, когда вы просматриваете логи. Они могут посещать вас, но логи утверждают, что кто-то использует Microsoft броузер и т.д. Некоторые роботы идентифицируют себя использованием имени поисковика (googlebot) или его клона (Scooter = AltaVista).

В зависимости от того, как робот настроен, информация индексируется, а затем доставляется в базы данных поисковой машины.

Базы данных поисковых машин подвергаются модификации в различные сроки. Даже директории, имеющие вторичные поисковые результаты используют данные роботов как содержание своего web-сайта.

Собственно, роботы не используются поисковиками лишь для вышеизложенного. Существуют роботы, которые проверяют баз данных на наличие нового содержания, навещают старое содержимое базы, проверяют, не изменились ли ссылки, загружают целые сайты для просмотра и так далее.

По этой причине, чтение лог-файлов и слежение за выдачей поисковой системы помогает вам наблюдать за индексацией ваших проектов.

Поисковый паук (другие наименования - робот, веб-паук, краулер) - программа поисковой системы, сканирующая веб-ресурсы для отражения сведений о них в базе данных.

С какой целью создают поисковых пауков?

Приведём элементарный пример. Представим себе Иванова Валерия, который регулярно посещает сайт http://it-ebooks.info/ , где ежедневно публикуются новые электронные книги. Заходя на ресурс, Валерий выполняет заданную последовательность действий:

1) открывает главную страницу;

2) заходит в раздел «Последние загруженные произведения»;

3) оценивает новинки из списка;

4) при появлении интересных заголовков, проходит по ссылкам;

5) читает аннотацию и, если она интересна, скачивает файл.

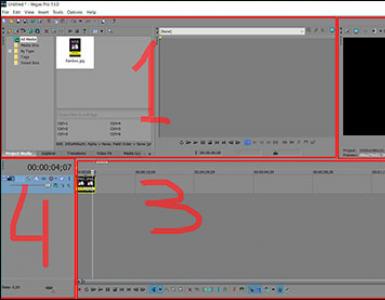

Указанные действия отнимают у Валерия 10 минут. Однако, если тратить на поиск 10 минут в день, в месяц это уже 5 часов. Вместо этого к задаче можно привлечь программу, отслеживающую новинки по расписанию. По механизму действия она будет представлять собой простейшего веб-паука, заточенного под выполнение определенных функций. Без краулеров не выживет никакая поисковая система, будь то лидеры Google и «Яндекс» или предприимчивые стартапы. Боты перемещаются по сайтам, отыскивая сырье для поисковой системы. При этом чем с большей отдачей трудится паук, тем актуальнее результаты выдачи (рис. 1) .

Рис. 1. Схема работы краулера

Рис. 2. Различия в проверках краулера (схема)

Рис. 3. Пример простого файла robots.txt

Функции веб-пауков

В зависимости от поисковой системы, функции, которые мы перечислим ниже, могут выполнять один или несколько роботов.

1. Сканирование контента сайта. Функция краулера первого порядка - обнаружение вновь созданных страниц и сбор размещенной текстовой информации.

2. Считывание графики. Если поисковая система подразумевает поиск графических файлов, для этой цели может быть введен отдельный веб-паук.

3. Сканирование зеркал. Робот находит идентичные по содержанию, но разные по адресу, ресурсы. «Работник», наделенный такими должностными полномочиями, есть у «Яндекса».

Виды поисковый роботов

У поисковых систем есть несколько пауков, каждый из которых поддерживает выполнение запрограммированных функций (рис. 2) .

Пауки «Яндекс»

- Yandex/1.01.001 (compatible; Win16; I) - центральный поисковый продукт «Яндекса», который индексирует контент.

- Yandex/1.01.001 (compatible; Win16; P) - робот, который индексирует картинки и фотографии.

- Yandex/1.01.001 (compatible; Win16; H) - отыскивает зеркала и дубли ресурса.

- Yandex/1.03.003 (compatible; Win16; D) - первый паук, который приходит на ресурс после добавления его через раздел вебмастера. Его задачи - проверка добавленных параметров, указанных в панели, на соответствие.

- Yandex/1.03.000 (compatible; Win16; M) - краулер, который посещает страницу после ее загрузки по ссылке «Найденные слова» в поисковой выдаче.

- YaDirectBot/1.0 (compatible; Win16; I) - индексирует сайты из рекламной сети «Яндекса» (РСЯ).

- Yandex/1.02.000 (compatible; Win16; F) - бот сканирует фавиконы сайтов.

Пауки Google

- Googlebot - центральный робот.

- Googlebot News - бот, который находит и индексирует новости.

- Google Mobile - анализирует версии сайтов для смартфонов.

- Googlebot Images - веб-паук, индексирующий графику.

- Googlebot Video - сканирует видеоролики и индексирует их.

- Google AdsBot - оценивает страницу по качественным параметрам.

- Google Mobile AdSense и Google AdSense - индексируют сайты рекламной сети Google.

Вежливые пауки - как научить роботов правилам поведения

Вежливыми называют краулеров, которые действуют, придерживаясь существующих правил поведения на сайте. Эти правила пишут вебмастеры, размещая их в файле robots.txt (рис. 3) . Пауки, которые попадают на сайт, на начальном этапе изучают информацию в указанном файле, где перечислены страницы, содержание которых не подлежит разглашению (регистрационные данные пользователей, административные сведения). Получив указания, паук приступает к индексации сайта, либо покидает его.

В robots.txt прописывают:

Вежливый робот всегда представляется и указывает в заголовке запроса реквизиты, которые дают возможность вебмастеру связаться с владельцем. Для чего вводятся ограничения? Владельцы ресурсов заинтересованы в привлечении реальных пользователей и не желают, чтобы программы строили на их контенте свой бизнес. Для этих целей сайты часто настраивают на обслуживание браузерных HTTP-запросов и лишь за тем - запросов от программ.