GPU vs CPU: Почему для анализа финансовых данных применяют графические процессоры. Графический процессор – что это такое

Процессоры и графические ускорители очень похожи, они оба сделаны из сотен миллионов транзисторов и могут обрабатывать тысячи операций за секунду. Но чем именно отличаются эти два важных компонента любого домашнего компьютера?

В данной статье мы попытаемся очень просто и доступно рассказать, в чем отличие CPU от GPU. Но сначала нужно рассмотреть два этих процессора по отдельности.

CPU (Central Processing Unit или же Центральное Процессорное Устройство) часто называют "мозгом" компьютера. Внутри центрального процессора расположено около миллиона транзисторов, с помощью которых производятся различные вычисления. В домашних компьютерах обычно устанавливаются процессоры, имеющие от 1 до 4 ядер с тактовой частотой приблизительно от 1 ГГц до 4 ГГц.

Процессор является мощным, потому что может делать все. Компьютер способен выполнить какую-либо задачу, так как процессор способен выполнить эту задачу. Программистам удалось достичь этого благодаря широким наборам инструкций и огромным спискам функций, совместно используемых в современных центральных процессорах.

Что такое GPU?

GPU (Graphics Processing Unit или же Графическое Процессорное Устройство) представляет собой специализированный тип микропроцессора, оптимизированный для очень специфических вычислений и отображения графики. Графический процессор работает на более низкой тактовой частоте в отличие от процессора, но имеет намного больше процессорных ядер.

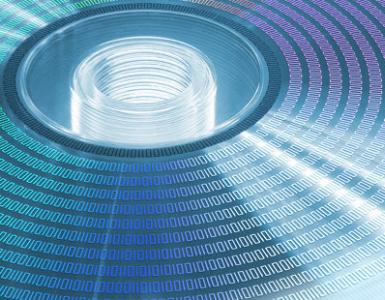

Также можно сказать, что GPU - это специализированный CPU, сделанный для одной конкретной цели - рендеринг видео. Во время рендеринга графический процессор огромное количество раз выполняет несложные математические вычисления. GPU имеет тысячи ядер, которые будут работать одновременно. Хоть и каждое ядро графического процессора медленнее ядра центрального процессора, это все равно эффективнее для выполнения простых математических вычислений, необходимых для отображения графики. Этот массивный параллелизм является тем, что делает GPU способным к рендерингу сложной 3D графики, требуемой современными играми.

Отличие CPU и GPU

Графический процессор может выполнить лишь часть операций, которые может выполнить центральный процессор, но он делает это с невероятной скоростью. GPU будет использовать сотни ядер, чтобы выполнить срочные вычисления для тысяч пикселей и отобразить при этом сложную 3D графику. Но для достижения высоких скоростей GPU должен выполнять однообразные операции.

Возьмем, например, Nvidia GTX 1080. Данная видеокарта имеет 2560 шейдерных ядер. Благодаря этим ядрам Nvidia GTX 1080 может выполнить 2560 инструкций или операций за один такт. Если вы захотите сделать картинку на 1% ярче, то GPU с этим справится без особого труда. А вот четырехъядерный центральный процессор Intel Core i5 сможет выполнить только 4 инструкции за один такт.

Тем не менее, центральные процессоры более гибкие, чем графические. Центральные процессоры имеют больший набор инструкций, поэтому они могут выполнять более широкий диапазон функций. Также CPU работают на более высоких максимальных тактовых частотах и имеют возможность управлять вводом и выводом компонентов компьютера. Например, центральный процессор может интегрироваться с виртуальной памятью, которая необходима для запуска современной операционной системы. Это как раз то, что графический процессор выполнить не сможет.

Вычисления на GPU

Даже несмотря на то, что графические процессоры предназначены для рендеринга, они способны на большее. Обработка графики - это только вид повторяющихся параллельных вычислений. Другие задачи, такие как майнинг Bitcoin и взломы паролей полагаются на одни и те же виды массивных наборов данных и простых математических вычислений. Именно поэтому некоторые пользователи используют видеокарты для не графических операций. Такое явление называется GPU Computation или же вычисления на GPU.

Выводы

В данной статье мы провели сравнение CPU и GPU. Думаю, всем стало понятно, что GPU и CPU имеют схожие цели, но оптимизированы для разных вычислений. Пишите свое мнение в комментариях, я постараюсь ответить.

Многие видели аббревиатуру GPU, но не каждый знает, что это такое. Это компонент , который входит в состав видеокарты . Иногда его называют видеокарта, но это не правильно. Графический процессор занимается обработкой команд, которые формируют трехмерное изображение. Это основной элемент, от мощности которого зависит быстродействие всей видеосистемы.

Есть несколько видов таких чипов – дискретный и встроенный . Конечно, сразу стоит оговорить, что лучше первый. Его ставят на отдельные модули. Он мощный и требует хорошего охлаждения . Второй устанавливается практически на все компьютеры. Он встраивается в CPU, делая потребление энергии в разы ниже. Конечно, с полноценными дискретными чипами ему не сравниться, но на данный момент он показывает довольно хорошие результаты .

Как работает процессор

GPU занимается обработкой

2D и 3D графики. Благодаря GPU ЦП компьютера становится свободнее и может выполнять более важные задачи. Главная особенность графического процессора в том, что он старается максимально увеличить скорость

расчета графической информации. Архитектура чипа позволяет с большей эффективностью

обрабатывать графическую информацию, нежели центральный CPU ПК.

GPU занимается обработкой

2D и 3D графики. Благодаря GPU ЦП компьютера становится свободнее и может выполнять более важные задачи. Главная особенность графического процессора в том, что он старается максимально увеличить скорость

расчета графической информации. Архитектура чипа позволяет с большей эффективностью

обрабатывать графическую информацию, нежели центральный CPU ПК.

Графический процессор устанавливает расположение трехмерных моделей в кадре. Занимается фильтрацией входящих в них треугольников, определяет, какие находятся на виду, и отсекает те, которые скрыты другими объектами.

Все мы знаем, что у видеокарты и процессора несколько различные задачи, однако знаете ли вы, чем они отличаются друг от друга во внутренней структуре? Как CPU (англ. - central processing unit ), так и GPU (англ. - graphics processing unit ) являются процессорами, и между ними есть много общего, однако сконструированы они были для выполнения различных задач. Подробнее об этом вы узнаете из данной статьи.

CPU

Основная задача CPU, если говорить простыми словами, это выполнение цепочки инструкций за максимально короткое время. CPU спроектирован таким образом, чтобы выполнять несколько таких цепочек одновременно или разбивать один поток инструкций на несколько и, после выполнения их по отдельности, сливать их снова в одну, в правильном порядке. Каждая инструкция в потоке зависит от следующих за ней, и именно поэтому в CPU так мало исполнительных блоков, а весь упор делается на скорость выполнения и уменьшение простоев, что достигается при помощи кэш-памяти и конвейера .

GPU

Основная функция GPU - рендеринг 3D графики и визуальных эффектов, следовательно, в нем все немного проще: ему необходимо получить на входе полигоны, а после проведения над ними необходимых математических и логических операций, на выходе выдать координаты пикселей. По сути, работа GPU сводится к оперированию над огромным количеством независимых между собой задач, следовательно, он содержит большой объем памяти, но не такой быстрой, как в CPU, и огромное количество исполнительных блоков: в современных GPU их 2048 и более, в то время как у CPU их количество может достигать 48, но чаще всего их количество лежит в диапазоне 2-8.

Основные отличия

CPU отличается от GPU в первую очередь способами доступа к памяти. В GPU он связанный и легко предсказуемый - если из памяти читается тексел текстуры, то через некоторое время настанет очередь и соседних текселов. С записью похожая ситуация - пиксель записывается во фреймбуфер, и через несколько тактов будет записываться расположенный рядом с ним. Также графическому процессору, в отличие от универсальных процессоров, просто не нужна кэш-память большого размера, а для текстур требуются лишь 128–256 килобайт. Кроме того, на видеокартах применяется более быстрая память, и в результате GPU доступна в разы большая пропускная способность, что также весьма важно для параллельных расчетов, оперирующих с огромными потоками данных.

Есть множество различий и в поддержке многопоточности: CPU исполняет 1– 2 потока вычислений на одно процессорное ядро, а GPU может поддерживать несколько тысяч потоков на каждый мультипроцессор, которых в чипе несколько штук! И если переключение с одного потока на другой для CPU стоит сотни тактов, то GPU переключает несколько потоков за один такт.

В CPU большая часть площади чипа занята под буферы команд, аппаратное предсказание ветвления и огромные объемы кэш-памяти, а в GPU большая часть площади занята исполнительными блоками. Вышеописанное устройство схематично изображено ниже:

Разница в скорости вычислений

Если CPU - это своего рода «начальник», принимающий решения в соответствии с указаниями программы, то GPU - это «рабочий», который производит огромное количество однотипных вычислений. Выходит, что если подавать на GPU независимые простейшие математические задачи, то он справится значительно быстрее, чем центральный процессор. Данным отличием успешно пользуются майнеры биткоинов.

Майнинг Bitcoin

Суть майнинга заключается в том, что компьютеры, находящиеся в разных точках Земли, решают математические задачи, в результате которых создаются биткоины . Все биткоин-переводы по цепочке передаются майнерам, чья работа состоит в том, чтобы подобрать из миллионов комбинаций один-единственный хэш, подходящий ко всем новым транзакциям и секретному ключу, который и обеспечит майнеру получение награды в 25 биткоинов за раз. Так как скорость вычисления напрямую зависит от количества исполнительных блоков, получается, что GPU значительно лучше подходят для выполнения данного типа задачи, нежели CPU. Чем больше количество произведенных вычислений, тем выше шанс получить биткоины. Дело даже дошло до сооружения целых ферм из видеокарт.

GPU (Graphics Processing Unit) является электронным устройством, разработанным для построения и обработки 2D или 3D изображения с последующим его выводом на экран. GPU широко используются в настольных компьютерных системах, мобильных телефонах, серверах и игровых консолях.

Применение GPUСовременные графические чипы устанавливаются на платах компьютерных видеокарт или интегрируются в материнские платы с целью экономии занимаемого компьютером пространства.

GPU позволяют эффективно обрабатывать компьютерную графику, что делает их самой используемой разновидностью чипов для вывода графической информации на экран. Впервые термин GPU был применен в 1999 г. компанией Nvidia на презентации видеокарты GeForce 256, которая на тот момент была самой производительной платой компании. Процессор модели мог обрабатывать около 10 млн графических полигонов в секунду.ФункцииGPU состоит из специальных транзисторов, большинство которых используется для обработки трехмерных изображений. Изначально графические процессоры были созданы с целью ускорения построения текстур и скорости обработки графических полигонов компьютерами, однако позднее графические ядра научились производить геометрические вычисления, что также ускорило скорость и качество показа изображений. Последние разработки в GPU включают в себя активацию поддержки программируемых шейдеров, технологии для уменьшения эффектов наложения элементов изображения друг на друга. Также новые графические процессоры способны более точно передавать цвета на монитор. Современные видеокарты поддерживают потоковую трансляцию видеоизображения с различных источников, подключенных через специальные интерфейсы.Типы GPUГрафические платы можно разделить на три типа: дискретные, встроенные и гибридные. Дискретные видеокарты устанавливаются в отдельный слот на материнской плате компьютера или портативного устройства (ноутбука) через специальный интерфейс (например, PCI-Express или AGP). Данная разновидность GPU имеет наиболее мощные производительные характеристики за счет особой структуры видеомодуля и его мощностных показателей. Также при необходимости дискретная видеокарта может быть с легкостью заменена на плату другой модели. Такие технологии, как SLI или CrossFire, позволяют объединять несколько видеоплат, чтобы еще больше улучшить производительность графической подсистемы.Встроенные GPU используются в портативных устройствах и имеют скромные вычислительные показатели из-за малого размера платы, а также сложностей их систем охлаждения и структурных особенностей. Гибридные видеокарты являются новым классом адаптеров, которые призваны заменить встроенные и дискретные модули. Новая технология создается с целью увеличения скорости обмена данными с системной оперативной памятью и процессором для улучшения производительности графики в целом. Гибридная карточка может быть встроена в материнскую плату, но при этом работать на базе технологии дискретных видеокарт PCI-Express.

Если вы можете похвастаться компьютером с хорошей видеокартой, то можно начать добывать биткоины прямо сейчас. Однако для того, чтобы увеличить прибыль и заниматься этим профессионально, мы рекомендуем приобрести несколько видеокарт (оптимально от 4 до 6) и собрать собственную .

За счёт установки нескольких видеоадаптеров вы сможете повысить уровень производительности компьютера, который будет считать намного быстрее т.к. именно видеокарты дают всю вычислительную мощность для майнинга (для большинства алгоритмов).

Отметим, что с учетом текущих цен на видеокарты в 2019 году стал выгоднее облачный GPU майнинг, который выгоднее покупки собственного оборудования, намного более гибкий в размере инвестиций и не требует обслуживания своих ферм. Мы сделали с рейтингом лучших сервисов по итогам нескольких последних лет.

Навигация по материалу:

Сколько можно заработать на одной видеокарте?

Имея некоторое представление о том, как , следует знать, какие видеоадаптеры подходят лучше всего для майнинга. Отличным вариантом станет AMD Radeon пятой серии и выше. Так как от производительности данного девайса будет зависеть итоговая сумма вашего заработка, рекомендуется обзавестись флагманами.

Есть мнение, что при использовании видеокарт производства AMD скорость вычисления немного выше, чем у аналогов под брендом nVidia. Но это сильно зависит от алгоритма вычислений на котором строится каждая конкретная криптовалюта. Соответственно, чем больше вычислений в секунду, тем существеннее ваш заработок.

Важно помнить, что если вы решите майнить, используя одну, даже самую топовую видеокарту, её производительности будет недостаточно. Вы потратите очень много времени, прежде чем добудете 1 BTC. Например, если будет задействован GPU Radeon HD 7970, ваш результат будет около 555 MH/s, а дневная добыча — на уровне 0,0031 BTC, или 80 центов. При этом стоит учитывать, что во время майнинга потребление электроэнергии возрастает. Поэтому такой способ добычи криптовалюты считается нецелесообразным.

Какую видеокарту выбрать — производительность на разных алгоритмах

Зная, как заработать на видеокарте, будущий майнер оказывается перед непростым выбором между тем или иным видеоадаптером, который необходимо приобрести для самодельной фермы.

GTX 1080

GTX 1050

Приведённые в таблице модели окупаются намного быстрее своих аналогов и являются, судя по отзывам специалистов, наилучшим выбором для майнинга в 2019 году. Например, GTX 1070/1060 и RX 480/470 окупятся за 5-6 месяцев. Также не стоит забывать, что добывать криптовалюту с каждым днем становится всё сложнее, однако её стоимость постоянно растёт, что позволяет удерживать необходимый баланс, привлекая к майнингу новых людей.

Наиболее популярными для майнинга криптовалюты являются решения от лагеря красных — AMD. Связано это с конструктивными особенностями видеокарт, поэтому пользователи в первую очередь скупают такие решения, как Radeon RX 470 и выше. Тем не менее сегодня отставание по мощности для майнинга видеоадаптеров от Nvidia не колоссальное, поэтому такие популярные модели, как GTX 1060 и выше разлетаются как горячие пирожки.

Кстати, теория заговора о повышения интереса к криптовалюте со стороны производителей видеокарт имеет место быть, поскольку компания Nvidia готовит специализированные видеокарты для майнинга под названиями P104-100 и P106-100. Отличаются эти решения от классических видеоадаптеров тем, что ни не имеют видеовыходов, оснащены слабым охлаждением и обладают ограниченной гарантией. Именно поэтому обычному пользователю все же рентабельнее приобрести топовое решение в лице той же GTX 1070, ведь ее всегда можно будет продать геймеру, тем самым частично отбив ее первоначальную стоимость.

Расчет окупаемости видеокарт

| GPU: | Окупаемость: | Без учета э/энергии: |

|---|---|---|

| Radeon RX 470 | 183 дня. (16% в мес) | 145 дней. (20.6% в мес) |

| Radeon RX 480 | 193 дня (15.5% в мес) | 156 дней (19.2% в мес) |

| Geforce GTX 1060 | 154 дня (19.4% в мес) | 130 дней (23% в мес) |

| Geforce GTX 1070 | 185 дней (16.2% в мес) | 162 дня (18.5% в мес) |

| Radeon Fury X | 278 дней (10.7% в мес) | 213 дней (14% в мес) |

Как вы могли заметить из таблицы выше, самыми выгодными для майнинга на данный момент являются видеокарты Nvidia Geforce GTX 1060 3gb и Radeon RX 470 4gb. Стоит отметить, что это справедливо только на данный момент и на самом выгодном сейчас алгоритме Equihash, что будет дальше, какие алгоритмы появятся в будущем и как на них поведут себя данные видеокарты не известно.

Если вас интересует доходность майнинга именно сейчас, то вы можете выбирать Geforce GTX 1060 если вы поклонник Nvidia или Radeon RX 470 — если предпочитаете GPU от AMD. Для расчета прибыльности майнинга используются (данные в них могут сильно различаться даже в течении одного дня, поскольку курс может резко меняться).

Разгон видеокарт для повышения хешрейта при майнинге

Повышение производительности GPU карт для майнинга это неотъемлемая часть настройки фермы. Разгон может производиться с помощью специальных программ работающих из операционной системы, для этого мы рекомендуем MSI Afterburner. Также может быть достигнут за счет перепрошивки биоса.

Подробно , там же присутствуют и видео инструкции для карт AMD и Nvidia (принцип их разгона немного различается).

Стоит отметить, что гарантия на эти видеокарты составляет всего 3 месяца . Запуск видеокарт для майнинга на Nvidia GTX ожидается в середине июня, но у разных поставщиков сроки могут меняться. Заявлено, что на графическом чипе P104-100 производительность/ватт увеличилась на 30% в сравнении с GTX 1060 3 Гб. А чип P106-100 в сравнении с той же видеокартой дает прирост 10%. Обе видеокарты выпускаются без видеоинтерфейсов.

Видеокарта Nvidia P104-100 использует тот же самый дизайн что и Nvidia GeForce GTX 1080. Но предоставляет гораздо больше производительности на 1 ватт потребленной электроэнергии, так как адаптер специально доработан для майнинга на Nvidia GTX. Карты от разных производителей поставляются с разными частотами чипов, в то время как эта базовая модель работает на базовой частоте 1607 МГц. Разгонная частота составляет 1733 МГц с пропускной способностью памяти 10 Гб/с GDDR5X при ширине шины в 256 бит.

Питание подается при помощи одного 8-контактного разъема, а энергопотребление примерно составляет 180 Вт. Базовая модель графического адаптера планируется к отгрузке по цене 350 долларов США, а вот модель от производителя Inno3D заявлена по цене в 370$ – Inno3D P6D-N104-1SDN P104-100 Twin X2 8GB GDDR5X. Эти цены значительно меньше, чем цены на их игровые аналоги (499$).

Заявленная производительность майнинга на Nvidia GTX P104-100 будет приблизительно около 60 МХ/с, но эта производительность будет достигнута только после обновления BIOS адаптера на новую прошивку.

Модель Nvidia P106-100 использует ту же конструкцию, что и Nvidia GeForce GTX 1060. Это дало возможность настроить графический адаптер под майнинг на Nvidia GTX значительно более эффективно. Адаптер работает на базовой частоте в 1506 МГц, турбо частота при этом составляет 1708 МГц, а пропускная способность памяти 8 Гб/с GDDR5 при шине 192 бита. Питание будет передаваться через 6-контактный разъем, а энергопотребление составит 120 Вт.

Цена базовой модели на рынке США составит 200$, что на 49$ дешевле игрового аналога GeForce GTX 1060 6 Гб. Вот цена конкретного адаптера Inno3D (N5G-N106-4SDN P106-100 Twin X2 6GB GDDR5) – 235$.