Пропускная способность каналов связи. Скорость интернет-соединения

Тема 2.5. Пропускная способность канала связи

В любой системе связи через канал передаётся информация. Её скорость передачи зависит не только от самого канала, но и от свойств подаваемого на его вход сигнала и поэтому не может характеризовать канал как средство передачи информации. Найдём способ оценки способности канала передавать информацию. Для каждого источника количество информации, переданной по каналу принимает своё значение.

Максимальное количество переданной информации, взятое по всевозможным источникам входного сигнала, характеризует сам канал и называется пропускной способностью канала в расчёте на один символ:

Бит/ симв.

(где максимизация производится по всем многомерным распределениям вероятностей Р(А))

Можно также определить пропускную способность С канала в расчёте на единицу времени.

Вычислим пропускную способность симметричного канала без памяти

![]() (2.26)

(2.26)

Величина  в данном случае легко вычисляется, поскольку условная (переходная) вероятность принимает только два значения: , если и (1-Р), если .

в данном случае легко вычисляется, поскольку условная (переходная) вероятность принимает только два значения: , если и (1-Р), если .

Первое из этих значений возникает с вероятностью Р, а второе – с вероятностью (1-Р). К тому же, поскольку рассматривается канал без памяти, результаты приёма отдельных символов независимы друг от друга.

(2.27)

(2.27)

Следовательно Н(В/А) не зависит от распределения вероятности в ансамбле А, а определяется только переходными вероятностями канала. Это свойство сохраняется для всех моделей с аддитивным шумом.

Подставив (2.27) в (2.26) получим:

Поскольку в правой части только член Н(В) зависит от распределения вероятности Р(А), то максимизировать необходимо именно его.

Максимальное значение Н(В) равно log m и реализуется оно тогда, когда все принятые символы равновероятны и независимы друг от друга. Легко убедиться, что это условие удовлетворяется, если входные символы равновероятны и независимы, поскольку в этом случае

При этом и

Отсюда пропускная способность в расчёте на единицу времени

Для двоичного симметричного канала (m=2) пропускная способность в двоичных единицах в единицу времени

Зависимость от Р согласно формуле (2.31)

При Р=1/2 пропускная способность двоичного канала С=0, поскольку при такой вероятности ошибки последовательность выходных двоичных символов можно получить совсем не передавая сигналы по каналу, а выбирая их наугад (например, по результатам бросания монеты), то есть при Р=1/2 последовательности на выходе и входе канала независимы. Случай С=0 называется обрывом канала. То, что пропускная способность при P=1 в двоичном канале такая же, как при Р=0 (канал без шумов), объясняется тем, что при Р=1 достаточно все выходные символы инвертировать (то есть заменить 0 на 1 и 1 на 0), чтобы правильно восстановить входной сигнал.

Пропускная способность непрерывного канала вычисляется аналогично. Пусть, например, канал имеет ограниченную полосу пропускания шириной F. Тогда сигналы U(t) и Z(t) соответственно на входе и выходе канала по теореме. Котельникова определяются своими отсчётами, взятыми через интервал 1/(2F), и поэтому информация, проходящая по каналу за некоторое время Т, равна, сумме количества информации, переданной за каждый такой отсчёт. Пропускная способность канала на один такой отсчёт:

Здесь U и Z – случайные величины – сечения процессов U(t) и Z(t) на входе и выходе канала соответственно и максимум берётся по всем допустимым входным сигналам, то есть по всем распределениям U.

Пропускная способность С определяется как сумма значений , взятая по всем отсчётам за секунду. При этом разумеется дифференциальные энтропии в (2.35) должны вычисляться с учётом вероятностных связей между отсчётами.

Вычислим пропускную способность непрерывного канала без памяти с аддитивным белым гауссовским шумом, имеющим полосу пропускания шириной F, если средняя мощность сигнала . Мощность (дисперсию) шума в полосе F обозначим . Отсчёты выходного и входного сигналов, а также шума N связаны равенством:

Так как N имеет нормальное распределение с нулевым математическим ожиданием, то и условная плотность вероятности при фиксированном U будет так же нормальной – с математическим ожиданием U и дисперсией .

Пропускная способность на один отсчёт определятся по формуле (2.32):

Согласно (2.24) условная дифференциальная энтропия h(Z/U) нормального распределения не зависит от математического ожидания и равна . Поэтому для нахождения следует найти такую плотность распределения , при которой максимизируется h(Z). Из (2.33) учитывая, что U и N независимые случайные величины имеем для дисперсий

Таким образом, дисперсиия фиксирована, так как и заданы. Как известно, при фиксированной дисперсии максимальная дифференциальная энтропия обеспечивается нормальным распределением. Из (2.33) видно, что при нормальном одномерном распределении U распределение Z будет так же нормальным и, следовательно, обеспечивается максимум дифференциальной энтропии (2.24).

![]() (2.34)

(2.34)

Переходя к пропускной способности С в расчёте на секунду, заметим, что информация, переданная за несколько отсчётов, максимальна в том случае, когда отсчёты сигналов независимы. Этого можно достичь, если сигнал U(t) выбрать так, чтобы его спектральная плотность была равномерной в полосе F. Отсчёты разделённые интервалами, кратными 1/(2F), взаимно некоррелированы, а для гауссовских величин некоррелированность означает независимость. Поэтому пропускную способность С (за секунду) можно найти, сложив пропускные способности (2.35) для 2F независимых отсчётов:

(2.36)

(2.36)

Она реализуется, если U(t) – гауссовский процесс с равномерной спектральной плотностью в полосе частот F (квазибелый шум).

Из (2.36) видно, что если бы мощность сигнала не была ограничена, то пропускная способность была бы сколь угодно большой. Пропускная способность равна нулю, если отношение сигнал-шум в канале равно нулю. С ростом этого отношения пропускная способность увеличивается неограниченно, однако медленно, вследствие логарифмической зависимости.

Соотношение (2.36) называется формулой Шеннона. Эта формула имеет важное значение в теории информации, так как определяет зависимость пропускной способности рассматриваемого непрерывного канала от таких его технических характеристик, как ширина полосы пропускания и отношение сигнал шум. Формула Шеннона указывает на возможность обмена полосы пропускания на мощность сигнала и наоборот. Однако поскольку С зависит от F линейно, а от – по логарифмическому закону, компенсировать возможное сокращение полосы пропускания увеличением мощности сигнала, как правило, не выгодно. Более эффективным является обратный обмен мощности сигнала на полосу пропускания.

Максимальный объём информации, которую можно в среднем передать по непрерывному каналу за время ,

Для гауссовского канала

(2.37)

(2.37)

Заметим, что при Выражение (2.37) совпадает с характеристикой названной ёмкостью (объёмом) канала.

Эта тема является одной из центральных в теории информации. В ней рассматриваются предельные возможности каналов связи по передаче информации, определяются характеристики каналов, влияющие на эти возможности, исследуются в самом общем виде предельные возможности кодирования, обеспечивающие максимум помехоустойчивости и объема передаваемой информации.

Определения:

1. Скорость передачи информации – среднее количество информации, передаваемой через канал за единицу времени.

В случае канала без шума эта скорость равна V к *H к , где V к – количество символов, передаваемых через канал в единицу времени, H к – средняя энтропия одного символа сообщения на входе и выходе канала.

2. Производительность источника – средняя скорость поступления информации от источника сообщений.

Производительность источника находится по формуле V и *H и , где V и – количество символов, генерируемых источником в единицу времени, H и – средняя энтропия одного символа сообщения на выходе источника.

Пропускная способность канала связи – максимально возможная для данного канала скорость передачи информации. Будем обозначать ее С к .

Отметим еще одну важную характеристику канала – максимальную скорость передачи символов V к max через него. Она всегда ограничена. Поэтому максимальная скорость передачи информации достигается при использовании максимальной скорости передачи символов и максимальной средней энтропии V к max передаваемого символа. Ранее доказывалось, что максимальная средняя энтропия в расчете на одни символ достигается при равной вероятности и независимости их появления.

Поскольку источник информации совсем не обязательно выдает символы с такими характеристиками, для достижения максимально эффективного использования канала их необходимо кодировать. Ранее при изучении эффективного кодирования доказывалось, что именно эффективное кодирование обеспечивает получение после кодирования символов с требуемыми параметрами. Энтропия символов вторичного алфавита в результате такого кодирования при кодировании бесконечно больших блоков информационной последовательности в пределе равна log 2 m , где m – объем вторичного алфавита, используемого на выходе кодирующего устройства.

Учитывая это: С к =V к * H max = V к * log 2 m .

Если же m=2 (для кодирования используется двоичный код), то энтропия одного символа на выходе кодера будет равна 1, т.е. каждый символ двоичного эффективного кода будет нести 1 бит информации, а сами символы будут равновероятны и статистически независимы.

В этом случае С к =V к.

При передаче информации через канал связи стремятся к наиболее эффективному (в смысле объема передаваемой информации) его использованию.

Найдем требования к источнику информации, при которых возможна максимальная скорость передачи информации через канал.

Будем описывать источник информации параметрами V и и H и . Допустим, шум в канале связи отсутствует. Канал связи описывается своей пропускной способностью и объемом m алфавита.

Поскольку шума в канале нет, информация при передаче через него не искажается и не теряется. Поэтому скорости передачи информации на выходе источника V и *H и и на выходе канала будут совпадать. Наиболее эффективным будет такое использование канала, при котором производительность источника будет равна пропускной способности канала:

С к =V к max * log 2 m = V и * H и.

Таким образом, если известна средняя энтропия одного символа сообщения, поступающего с выхода источника, наиболее эффективного использования канала можно достичь, если скорость поступления этих символов от источника выбрать в соответствии с формулой: V и =V к max * log 2 m / H и или V и =V к max / H и при использовании наиболее часто употребляемого двоичного кодирования.

Заметим, что эта формула предполагает использование эффективного кодирования информации, поступающей от источника перед передачей ее в канал связи без помех (шума).

Рассмотрим следующую модель канала связи с помехами (рис. 4.4):

Рис. 4.4. Модель канала связи с помехами.

По виду передаваемых через канал сигналов различают дискретные и непрерывные каналы связи.

Важнейшей характеристикой канала является его пропускная способность, определяемая как наибольшая скорость передачи информации через него . Пропускная способность дискретного канала может быть рассчитана, например, по следующей формуле:

С= V k *I m а x ,

где V k – скорость передачи символов алфавита через канал;

I m а x – максимально возможное количество информации, приходящейся на один передаваемый через канал символ.

Количество информации, приходящееся на 1 передаваемый через канал символ зависит от энтропии (степени неопределенности получения символа) на входе и выходе канала. Согласно мере Шеннона

I = H априорная - H апостериорная = H(X) – H(X/Y) .

Здесь H априорная = H(X) и H апостериорная = H(X/Y) – условная энтропия, характеризующая неопределенность о переданном на выход канала символе X по принятому символу Y на выходе. Наличие этой неопределенности – следствие действия на передаваемый через канал символ помех. H(X/Y) – характеристика канала.

Конец работы -

Эта тема принадлежит разделу:

Теория информации и кодирования

Сочинский государственный университет.. туризма и курортного дела.. Факультет информационных технологий и математики..

Если Вам нужно дополнительный материал на эту тему, или Вы не нашли то, что искали, рекомендуем воспользоваться поиском по нашей базе работ:

Что будем делать с полученным материалом:

Если этот материал оказался полезным ля Вас, Вы можете сохранить его на свою страничку в социальных сетях:

| Твитнуть |

Все темы данного раздела:

Курс лекций

Эффективная организация обмена информации приобретает все большее значение как условие успешной практической деятельности людей. Объем информации, необходимый для нормального функционирования совре

Определение понятия информация

Слово информация происходит от латинского informare – изображать, составлять понятие о чем-либо, осведомлять.

Информация наряду с материей и энергией является первичны

Фазы обращения информации

Система управления состоит из объекта управления, комплекса технических средств, состоящего из компьютера, входящих в его состав устройств ввода-вывода и хранения информации, устройств сбора переда

Некоторые определения

Данные или сигналы, организованные в определенные последовательности, несут информацию не потому, что они повторяют объекты реального мира, а по общественной договоренности о кодировании, т.е. одно

Меры информации

Прежде, чем перейти к мерам информации, укажем, что источники информации и создаваемые ими сообщения разделяются на дискретные и непрерывные. Дискретные сообщения слагаются из конечно

Геометрическая мера

Определение количества информации геометрическим методом сводится к измерению длины линии, площади или объема геометрической модели данного носителя информации или сообщения. По геометрическим разм

Аддитивная мера (мера Хартли)

Аддитивную меру можно рассматривать как более удобную для ряда применений комбинаторную меру. Наши интуитивные представления об информации предполагают, чтобы количество информации увеличивалось пр

Энтропия и ее свойства

Существует несколько видов статистических мер информации. В дальнейшем будем рассматривать только одну их них ─ меру Шеннона. Мера Шеннона количества информации тесно связана с понятие

Энтропия и средняя энтропия простого события

Рассмотрим подробнее понятие энтропии в разных вариантах, так как оно используется в шенноновской теории информации. Энтропия - мера неопределенности некоторого опыта. В простейшем случае его ис

Метод множителей Лагранжа

Вывод формулы среднего значения энтропии на букву сообщения

Энтропия сложного события, состоящего из нескольких зависимых событий

Избыточность сообщения

Содержательность информации

Целесообразность информации

Динамическая энтропия

Энтропия непрерывных сообщений

Первый случай (значения сл. величины ограничены интервалом)

Второй случай (заданы дисперсия и математическое ожидание сл. величины)

Квантование сигналов

Виды дискретизации (квантования)

Критерии точности представления квантованного сигнала

Элементы обобщенной спектральной теории сигналов

О практическом использовании теоремы Котельникова

Выбор периода дискретизации (квантования по времени) по критерию наибольшего отклонения

Интерполяция при помощи полиномов Лагранжа

Оценка максимального значения ошибки при получении воспроизводящей функции на основе полинома Лагранжа

Обобщение на случай использования полиномов Лагранжа произвольного порядка

Выбор интервала дискретизации по критерию среднеквадратического отклонения

Оптимальное квантование по уровню

Расчет неравномерной оптимальной в смысле минимума дисперсии ошибки шкалы квантования

Общие понятия и определения. Цели кодирования

Элементы теории кодирования

Неравенство Крафта

Теорема 2.

Теорема 3.

Теорема о минимальной средней длине кодового слова при поблочном кодировании (теорема 4)

Оптимальные неравномерные коды

Лемма 1. О существовании оптимального кода с одинаковой длиной кодовых слов двух наименее вероятных кодируемых букв

Лемма 2. Об оптимальности префиксного кода нередуцированного ансамбля, если префиксный код редуцированного ансамбля оптимален

Особенности эффективных кодов

Помехоустойчивое кодирование

Простейшие модели цифровых каналов связи с помехами

Расчет вероятности искажения кодового слова в ДСМК

Общие принципы использования избыточности

Граница Хэмминга

Избыточность помехоустойчивых кодов

Линейные коды

Определение числа добавочных разрядов m

Построение образующей матрицы

Порядок кодирования

Порядок декодирования

Двоичные циклические коды

Некоторые свойства циклических кодов

Построение кода с заданной корректирующей способностью

Матричное описание циклических кодов

Выбор образующего полинома

Виды каналов передачи информации

Пропускная способность дискретного канала связи с шумом

Типичные последовательности и их свойства

Основная теорема Шеннона для дискретного канала с шумом

Обсуждение основной теоремы Шеннона для канала с шумом

Пропускная способность непрерывного канала при наличии аддитивного шума

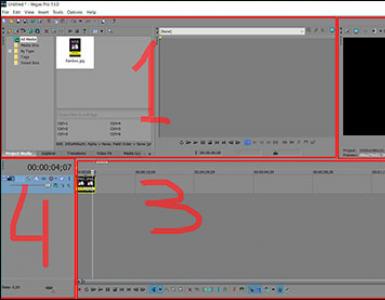

Шаг 2. Ввод текстовых файлов в Excel-таблицу с разбиением каждой строки текста на отдельные символы

Шаг 4. Находим среднюю энтропию, приходящуюся на 1 букву сообщения

Шаг 8. Напишем отчет о выполненной работе с описанием всех вычислений и о том, как они выполнялись. Прокомментируйте результаты

Подключение возможности использования нестандартных функций

Создание нестандартной функции

Запись голоса и подготовка сигнала

Импорт текстовых данных в Excel

Квантование по уровню сводится к замене значения исходного сигнала уровнем того шага, в пределы которого это значение попадает

Коды Хаффмена

Процесс повторяется до тех пор, пока в каждой подгруппе останется по одной букве

Параметры эффективности оптимальных кодов

Особенности эффективных кодов

Выполнение работы

Построение образующей матрицы

Порядок кодирования

Порядок декодирования

Выполнение работы

Рассмотрим канал связи, представленный на рис. 5-1. На его передающий конец подается сигнал x(t)

, который поступает на вход приемника в искаженном шумом n(t)

виде y(t)

[Л. 47, 53]. Введем понятие пропускной способности канала связи. Пропускная способность канала связи определяется как максимальная величина относительной информации выходного сигнала относительно входного: где I(x, y)

- относительная информация, задаваемая формулой (7-8), причем все сигналы рассматриваются как эквивалентные дискретные (рис. 7-1), так что Иногда величина где N=2f c t 0

. Если отсчеты независимы, то V=I 1 (х, y)

. Очевидно, что с помощью величины V

пропускная способность канала связи может быть определена по формуле Для энтропии шума можно написать: Н(n)=2f c t 0 H 1 (n),

Энтропия шума на один отсчет для нормального шума. Аналогичные формулы можно записать для нормальных сигналов х

и y

. Формулу (7-10) для единицы отсчета можно записать в виде Смысл этого определения требуется разъяснить. Отметим, что максимум здесь взят по множеству распределений вероятности входных сигналов при неизменном шуме, которое предполагается заданным. В частном случае это множество распределений может состоять из одного нормального, как это часто и считается. Если пропускная способность одного канала связи больше, чем другого (С 1 >С 2) при остальных одинаковых условиях, то физически это означает, что в первом случае совместная плотность распределения вероятности входного и выходного сигналов больше, чем во втором, так как с помощью формулы (7-11) нетрудно убедиться, что пропускная способность определяется в основном величиной совместной плотности распределения вероятности. Если относительная информация (или энтропия) выходного сигнала относительно входного больше, то канал обладает большей пропускной способностью. Ясно, что если шумы возрастают, то пропускная способность падает. Если вероятностная связь выходного и входного сигналов пропадает, то р(х,y)=р(х)р(y)

и в формуле (7-11) логарифм и, следовательно, пропускная способность становятся равными нулю. Другой случай, когда р(х,y)=р(х|y)р(у)

стремится к нулю, требует детального рассмотрения, так как log р(х,y)

стремится к - ∞. Если р(y)→

0, то Рассуждения можно продолжить следующим образом. Так как вероятность появления выходного сигнала стремится к нулю, то можно положить, что вероятность появления сигнала х

не зависит от y

, т. е. p(х|y)=р(х)

В этом случае пропускная способность равна нулю, что согласуется с физической интерпретацией, т. е. если на выходе канала связи не появляется никакого сигнала [ни полезного x(t)

, ни шумов n(t)

], это означает, что в канале есть "пробка" (разрыв). Во всех остальных случаях пропускная способность отлична от нуля. Естественно определить пропускную способность канала связи так, чтобы она не зависела от входного сигнала. Для этого введена операция максимизации, которая в соответствии с экстремальными свойствами энтропии чаще всего определяет входной сигнал с нормальным законом распределения. Покажем, что если x(t)

и n(t)

независимы и y(t)=x(t)+n(t)

, то I(х,y)=Н(y)-Н(n),

(7-12) где Н(y)

и Н(n)

- дифференциальные энтропии принимаемых сигнала и шума. Условие (7-12) означает линейность канала связи в том смысле, что шум просто добавляется к сигналу как слагаемое. Оно непосредственно следует из I(х,y)=Н(x)-Н(х|y)=Н(y)-Н(y|х).

Так как x

и n

статистически независимы, то Подставив это соотношение в предыдущее, получим (7-12). Очевидно, если шум аддитивен и не зависит от входного сигнала, то максимальная скорость передачи сообщений по каналу связи (максимальная пропускная способность) достигается при maxН(y)

, так как Рассмотрим гауссов канал связи, исходя из следующих предположений: ширина полосы частот канала ограничена частотой f с

; шум в канале - нормальный белый со средней мощностью на единицу полосы S n =S n 2

; средняя мощность полезного сигнала Р x

; сигнал и шум статистически независимы; выходной сигнал равен сумме полезного сигнала и шума. Очевидно, что в соответствии с формулой (7-4) пропускная способность такого канала определится как H(n)=Flog2πeS n f c .

(7-14) Так как сигнал и шум статистически независимы, то они не коррелированы между собой, поэтому средняя мощность суммарного сигнала Р y =Р x +S n f c =Р x +Р n

В соответствии с формулой (7-13) необходимо найти максимум энтропии сигнала y(t)

на один отсчет при заданной средней мощности. В силу экстремальных свойств энтропии (см. гл. 6) сигнал y(t)

должен быть распределен нормально. Белый шум в полосе f c

эквивалентен сигналу в этой же полосе со спектральной плотностью S

, если равны их средние мощности, т. е. Действительно, для нормального сигнала была доказана формула для энтропии на один отсчет В дискретной системе связи при

отсутствии помех информация на выходе канала связи (канала ПИ) полностью совпадает

с информацией на его входе, поэтому скорость передачи информации численно равна

производительности источника сообщений: При наличии помех часть информации

источника теряется и скорость передачи информации оказывается меньшей, чем

производительность источника. Одновременно в сообщение на выходе канала добавляется

информация о помехах (рис.5). Поэтому при наличии помех необходимо

учитывать на выходе канала не всю информацию, даваемую источником, а только

взаимную информацию: На основании формулы (20) имеем где H¢(x) -

производительность

источника;

H¢(x/y)

- "ненадёжность" канала(потери) в единицу времени; H¢(y)

- энтропия выходного

сообщения в единицу времени; H¢(y/x)

=H’(n)

–энтропия помех (шума) в единицу времени. Пропускной способностью канала

связи

(канала передачи информации) C

называется максимально возможная

скорость передачи информации по каналу Для достижения максимума учитываются

все возможные источники на выходе и все возможные способы кодирования. Таким образом, пропускная способность

канала связи равна максимальной производительности источника на входе канала,

полностью согласованного с характеристиками этого канала, за вычетом потерь

информации в канале из-за помех. В канале без помех C=max H¢(x)

,

так как H¢(x/y)=0

. При использовании равномерного кода с основанием k

, состоящего из n

элементов длительностью tэ

, в канале

без помех при k

=2

бит/c.

(25) Для эффективного использования

пропускной способности канала необходимо его согласование с источником информации

на входе. Такое согласование возможно как для каналов связи без помех, так и

для каналов с помехами на основании двух теорем, доказанных К.Шенноном. 1-ая теорема (для канала связи

без помех):

Если источник сообщений имеет

энтропию H (бит на символ), а канал связи – пропускную способность C (бит в

секунду), то можно закодировать сообщения таким образом, чтобы передавать

информацию по каналу со средней скоростью, сколь угодно близкой к величине C,

но не превзойти её.

К.Шеннон предложил и метод

такого кодирования, который получил название статистического или оптимального

кодирования. В дальнейшем идея такого кодирования была развита в работах Фано

и Хаффмена и в настоящее время широко используется на практике для “cжатия сообщений”. 2-ая теорема (для каналов

связи с помехами):

Если пропускная способность

канала равна C, а производительность источника H’(x) Не существует способа кодирования,

обеспечивающего ненадёжность, меньшую, чем H"(x)-C.

К сожалению, теорема К.Шеннона

для каналов с шумами(помехами) указывает только на возможность такого кодирования,

но не указывает способа построения соответствующего кода. Однако известно, что

при приближении к пределу, устанавливаемому теоремой Шеннона, резко возрастает

время запаздывания сигнала в устройствах кодирования и декодирования из-за

увеличения длины кодового слова n

. При этом вероятность ошибки на выходе

канала стремится к величине Cледовательно, имеет место “обмен” верности передачи

на скорость и задержку передачи. Одной из основных характеристик любой системы передачи информации, кроме перечисленных выше, является ее пропускная способность. Пропускная способность – максимально возможное количество полезной информации, передаваемое в единицу времени: c = max{Imax} / TC , c = [бит/с]. Иногда скорость передачи информации определяют как максимальное количество полезной информации в одно элементарном сигнале: s = max{Imax} / n, s = [бит/элемент]. Рассмотренные характеристики зависят только от канала связи и его характеристик и не зависят от источника. Пропускная способность дискретного канала связи без помех. В канале связи без помех информацию можно передавать неизбыточным сигналом. При этом число n = m, а энтропия элементарного сигнала HCmax = logK. max{IC} = nHCmax= mHCmax . Длительность элементарного сигнала , где – длительность элементарного сигнала. где FC – спектр сигнала. Пропускная способность канала связи без помех Введем понятие скорости генерации элементарного сигнала источником информации: Тогда, используя новое понятие, можно преобразовать формулу для скорости передачи информации: Полученная формула определяет максимально возможную скорость передачи информации в дискретном канале связи без помех. Это следует из предположения о том, что энтропия сигнала максимальна. Если HC < HCmax, то c = BHC и не является максимально возможной для данного канала связи. Пропускная способность дискретного канала связи с помехами. В дискретном канале связи с помехами наблюдается ситуация, изображенная на рис. 6. Учитывая свойство аддитивности, а также формулы Шеннона для определения количества информации, рассмотренные выше, можно записать IC = TC FC log(AK PC), IПОМ = TП FП log(APП). Для получателя источник полезной информации и источник помехи равноценны, поэтому нельзя на приемной стороне выделить составляющую помехи в сигнале с результирующей информацией IРЕЗ = TC FC log(AK (PП + PC)), если TC = TП, FC = FП. Приемник может быть узкополосным, а помеха находиться в других интервалах частот. В этом случае она не будет влиять на сигнал. Будем определять результирующий сигнал для наиболее “неприятного” случая, когда параметры сигнала и помехи близки друг к другу или совпадают. Полезная информация определяется выражением Эта формула получена Шенноном. Она определяет скорость передачи информации по каналу связи в случае, если сигнал имеет мощность PC, а помеха – мощность PП. Все сообщения при такой скорости передадутся с абсолютной достоверностью. Формула не содержит ответа на вопрос о способе достижения такой скорости, но дает максимально возможное значение с в канале связи с помехами, то есть такое значение скорости передачи, при которой полученная информация будет абсолютно достоверной. На практике экономичнее допустить определенную долю ошибочности сообщения, хотя скорость передачи при этом увеличится. Рассмотрим случай PC >> PП. Если ввести понятие отношения сигнал/шум PC >> PП означает, что . Тогда Полученная формула отражает предельную скорость мощного сигнала в канале связи. Если PC << PП, то с стремится к нулю. То есть сигнал принимается на фоне помех. В таком канале в единицу времени сигнал получить не удается. В реальных ситуациях полностью помеху отфильтровать нельзя. Поэтому приемник получает полезную информацию с некоторым набором ошибочных символов. Канал связи для такой ситуации можно представить в виде, изображенном на рис. 7, приняв источник информации за множество передаваемых символов {X}, а приемник – за множество получаемых символов {Y}. Рис.7 Граф переходных вероятностей K- ичного канала связи Между существует определенное однозначное соответствие. Если помех нет, то вероятность однозначного соответствия равна единице, в противном случае она меньше единицы. Если qi – вероятность принятия yi за xi, a pij = p{yi / xi} – вероятность ошибки, то Граф переходных вероятностей отражает конечный результат влияния помехи на сигнал. Как правило, он получается экспериментально. Полезная информация может быть оценена как IПОЛ = nH(X · Y), где n – количество элементарных символов в сигнале; H(X · Y) – взаимная энтропия источника X и источника Y. В данном случае источником X является источник полезной информации, а источником Y является приемник. Соотношение, определяющее полезную информацию, можно получить исходя из смысла взаимной энтропии: заштрихованный участок диаграммы определяет сообщения, переданные источником Xи полученные приемником Y; незаштрихованные участки отображают сигналы источника X, не дошедшие до приемника и полученные приемником посторонние сигналы, не передаваемые источником. B – скорость генерации элементарных символов на выходе источника. Для получения max нужно по возможности увеличить H(Y) и уменьшить H(Y/X). Графически эта ситуация может быть представлена совмещением кругов на диаграмме (Рис. 2г). Если же круги вообще не пересекаются, X и Y существуют независимо друг от друга. В дальнейшем будет показано, как можно использовать общее выражение для максимальной скорости передачи при анализе конкретных каналов связи. Характеризуя дискретный канал, используют два понятия скорости: техническая и информационная. Под технической скоростью передачи RT, называемой также скоростью манипуляции, подразумевают число символов (элементарных сигналов), передаваемых по каналу в единицу времени. Она зависит от свойств линии связи и быстродействия аппаратуры канала. С учетом различий в длительности символов техническая скорость определяется как где - среднее время длительности символа. Единицей измерения служит »бод» - это скорость, при которой за одну секунду передается один символ. Информационная скорость или скорость передачи информации определяется средним количеством информации, которое передается по каналу за единицу времени. Она зависит как от характеристик конкретного канала (таких как объем алфавита используемых символов, технической скорости их передачи, статистического свойства помех в линии), так и от вероятностей поступающих на вход символов и их статистической взаимосвязи. При известной скорости манипуляции скорость передачи информации по каналу задается соотношением: где – среднее количество информации, переносимое одним символом. Для практики важно выяснить, до какого предела и каким путем можно повысить скорость передачи информации по конкретному каналу. Предельные возможности канала по передаче информации характеризуются его пропускной способностью. Пропускная способность канала с заданными переходными вероятностями равна максимуму передаваемой информации по всем входным распределениям символов источника X: С математической точки зрения поиск пропускной способности дискретного канала без памяти сводится к поиску распределения вероятностей входных символов источника Х, обеспечивающего максимум переданной информации . При этом, на вероятности входных символов накладывается ограничение: В общем случае, определение максимума при заданных ограничениях возможно с помощью мультипликативного метода Лагранжа. Однако такое решение требует чрезмерно больших затрат. В частном случае для дискретных симметричных каналов без памяти пропускная способность (максимум , достигается при равномерном распределении входных символов источника X. Тогда для ДСК без памяти, считая заданной вероятность ошибки ε и для равновероятных входных символов = = = =1/2, можно получить пропускную способность такого канала по известному выражению для : где = – энтропия двоичного симметричного канала при заданной вероятности ошибки ε. Интерес представляют граничные случаи: 1. Передача информации по бесшумному каналу (без помех): При фиксированных основных технических характеристиках канала (например, полосе частот, средней и пиковой мощности передатчика), которые определяют значение технической скорости, пропускная способность канала без помех будет равна [бит/сек].

Если нужно найти экстремум (максимум, минимум или седловую точку) функции n переменных f(x1, x2, …, xn), связанных k

Предположим, имеется сообщение, состоящее из n букв: , где j=1, 2, …, n ─ номера букв в сообщении по порядку, а i1, i2, … ,in номера букв

Теперь предположим, что элементы сообщения (буквы) взаимозависимы. В этом случае вероятность появления последовательности из нескольких букв не равна произведению вероятностей появ

Как отмечалось, энтропия максимальна, если вероятности сообщений или символов, из которых они составлены, одинаковы. Такие сообщения несут максимально возможную информацию. Если же сообщение имеет

Мера содержательности обозначается cont (от английского Content ─ содержание).

Содержательность события I выражается через функцию меры содержательности его о

Если информация используется в системах управления, то ее полезность разумно оценивать по тому эффекту, который она оказывает на результат управления. В связи с этим в 1960 г. советским ученым А.А.

Здесь энтропия рассматривается как функция времени. При этом преследуется цель – избавиться от неопределенности, т.е. добиться положения, когда энтропия равна 0. Такая ситуация характерна для задач

Исходные данные часто представляются в виде непрерывных величин, например, температура воздуха или морской воды. Поэтому представляет интерес измерение количества содержащейся в таких сообщениях ин

Случайная величина a ограничена интервалом . В этом случае определенный интеграл ее плотности распределения вероятностей (дифференциального закона распределения вероятностей) на

Предположим теперь, что область определения значений случайной величины не ограничена, но задана ее дисперсия D и математическое ожидание M. Заметим, что дисперсия прямо пропорциональ

Непрерывные сигналы – носители информации – представляют собой непрерывные функции непрерывного аргумента – времени. Передача таких сигналов может выполняться при помощи непрерывных каналов связи,

Наиболее простыми и часто используемыми видами квантования являются:

· квантование по уровню (будем говорить просто квантование);

· квантование по времени (будем называть

В результате обратного преобразования из непрерывно-дискретной формы в непрерывную получается сигнал, отличающийся от исходного на величину ошибки. Сигнал называется воспроизводящей функц

Обобщенная спектральная теория сигналов объединяет методы математического описания сигналов и помех. Эти методы позволяют обеспечить требуемую избыточность сигналов с целью уменьшения влияния помех

Возможную схему квантования-передачи-восстановления непрерывного сигнала можно представить в виде, изображенном на рис. 2.5.

Рис. 2.5. Возможная схема квантования-передачи-

В результате квантования по времени функции x(t) получается ряд значений x(t1), x(t2), … квантуемой величины x(t) в дискретные моменты времени t

Воспроизводящая функция в большинстве случаев рассчитывается по формуле: , где − некоторые функции. Эти функции обычно стремятся выбрать так, чтобы. (2.14)

В этом случае,

Найдем погрешность интерполяции. Представим ее виде:

, (2.16)

где K(t) – вспомогательная функция, которую надо найти.

Для произвольного t* имеем:

(

Интерполяция полиномами n-го порядка рассматривается аналогично предыдущим случаям. При этом наблюдается значительное усложнение формул. Обобщение приводит к формуле следующего вида:

Рассмотрим случай дискретизации случайного стационарного эргодического процесса x(t) с известной корреляционной функцией. Восстанавливать будем при помощи полиномов Лагранжа. Наиболее часто

Рисунком 2.13 иллюстрируется принцип квантования по уровню.

Рис. 2.13. Квантование по уровню.

Это квантование сводится к замене значения исходного сигнала уровн

Рис. 2.19. Обозначения

Зададимся теперь числом шагов квантования n, границами интервала (xmin, xmax

Кодирование − операция отождествления символов или групп символов одного кода с символами или группами символов другого кода.

Код (франц. code), совокупность зна

Некоторые общие свойства кодов.

Рассмотрим на примерах. Предположим, что дискретный источник без памяти, т.е. дающий независимые сообщения – буквы – на выходе, име

Теорема 1. Если целые числа n1, n2, …, nk удовлетворяют неравенству, (3.1)

существует префиксный код с алфавитом объемом m,

Формулировка. Пусть задан код с длинами кодовых слов n1, n2, … , nk и с алфавитом объема m. Если код однозначно декодируем, неравенство Крафта удовле

Формулировка. При заданной энтропии H источника и объеме m вторичного алфавита существует префиксный код с минимальной средней длиной nср min

Рассмотрим теперь случай кодирования не отдельных букв источника, а последовательностей из L букв.

Теорема 4.

Формулировка. Для данного дискретного источника

Определения.

Неравномерными называют коды, кодовые слова которых имеют различную длину.

Оптимальность можно понимать по-разному, в зависимости о

Формулировка. Для любого источника с k>=2 буквами существует оптимальный (в смысле минимума средней длины кодового слова) двоичный код, в котором два наименее вероятных сло

Формулировка. Если некоторый префиксный код редуцированного ансамбля U"является оптимальным, то соответствующий ему префиксный код исходного ансамбля т

1. Букве первичного алфавита с наименьшей вероятностью появления ставится в соответствие код с наибольшей длиной (лемма 1), т.е. такой код является неравномерным (с разной длиной кодовых слов). В р

Как следует из названия, такое кодирование предназначено для устранения вредного влияния помех в каналах передачи информации. Уже сообщалось, что такая передача возможна как в пространстве, так и в

Свойство помехоустойчивых кодов обнаруживать и исправлять ошибки в сильной степени зависит от характеристик помех и канала передачи информации. В теории информации обычно рассматривают две простые

Положим, кодовое слово состоит из n двоичных символов. Вероятность неискажения кодового слова, как несложно доказать, равна:

.

Вероятность искажения одного символа (однокра

Для простоты рассмотрим блоковый код. С его помощью каждым k разрядам (буквам) входной последовательности ставится в соответствие n-разрядное кодовое слова. Количество разного вида

Граница Хэмминга Q, определяет максимально возможное количество разрешенных кодовых слов равномерного кода при заданных длине n кодового слова и корректирующей способности кода КСК

Одной из характеристик кода является его избыточность. Увеличение избыточности в принципе нежелательно, т.к. увеличивает объемы хранимых и передаваемых данных, однако для борьбы с искажениями избыт

Рассмотрим класс алгебраических кодов, называемых линейными.

Определение: Линейными называют блоковые коды, дополнительные разряды которых образуются

Для определения числа добавочных разрядов можно воспользоваться формулой границы Хэмминга:

.

При этом можно получить плотноупакованный код, т.е. код с минимальной при заданных пар

Линейные коды обладают следующим свойством: из всего множества 2k разрешенных кодовых слов, образующих, кстати, группу, можно выделить подмножества из k слов, обладающих св

Вышеприведенная процедура построения линейного кода имеет ряд недостатков. Она неоднозначна (МДР можно задать различным образом) и неудобна в реализации в виде технических устройств. Этих недостатк

Все свойства циклических кодов определяются образующим полиномом.

1. Циклический код, образующий полином которого содержит более одного слагаемого, обнаруживает все одиночные ошибки.

Существует несложная процедура построения кода с заданной корректирующей способностью. Она состоит в следующем:

1. По заданному размеру информационной составляющей кодового слова длиной

Циклические коды можно, как и любые линейные коды, описывать с помощью матриц.

Вспомним, что KC(X) = gm(X)*И(Х) .

Вспомним также на примере порядок умножения пол

Ясно, что полиномы кодовых слов КС(Х) должны делиться на образующий полином g(X) без остатка. Циклические коды относятся к классу линейных. Это означает, что для этих кодов существует

Рассмотрим каналы, отличающиеся по типу используемых в них линий связи.

1. Механические, в которых для передачи информации используется перемещение каких-либо твердых, жид

Исследуем теперь пропускную способность дискретного канала связи с шумом.

Существует большое количество математических моделей таких каналов. Простейшей из них является канал с независимой

Будем рассматривать последовательности статистически независимых букв. Согласно закону больших чисел, наиболее вероятными будут последовательности длиной n, в которых при количества N

Формулировка

Для дискретного канала в шумом существует такой способ кодирования, при котором может быть обеспечена безошибочная передача все информации, поступающей от источ

Теорема Шеннона для канала с шумом не указывает на конкретный способ кодирования, обеспечивающий достоверную передачу информации со скоростью, сколь угодно близкой с пропускной способности канала с

Рассмотрим следующую модель канала:

1. Канал способен пропускать колебания с частотами ниже Fm.

2. В канале действует помеха n(t), имеющая нормальный (гау

При вводе ранее сохраненного текстового файла следует указать тип файла *.*. Это позволит во время выбора видеть в списке все файлы. Укажите свой файл. После этого на экран будет выведено окно М

Как описано в теоретическом введении, средняя энтропия находится по формулам 1 и 2. В обоих случаях нужно найти вероятности появления букв или двухбуквенных комбинаций..

Вероятности можно

Результаты вычислений представьте в виде таблицы:

<Язык 1>

<Язык

Программное управление приложениями, входящими в состав Microsoft Office, осуществляется при помощи так называемых макросов.

Слово Макрос – греческого происхождения. В перево

Перед созданием нестандартных функций нужно открыть файл в рабочей книгой, содержащей информацию, которую нужно обработать с применением этих нестандартных функций. Если ранее эта рабочая книга был

Запись начинается и заканчивается нажатием кнопки Record (рис. 5), помеченной красный кружком. В процессе записи кнопка Recоrd выглядит вдавленной и более светлой (подсвеченной).

Двойным кликом откройте текстовый файл с экспортированные из программы Wavosaur данными (рис. 23).

Рис. 23. Примерный вид данных

Видно, что экспортированные

Квантование по уровню – необходимое условие преобразования непрерывного сигнала в цифровую форму. Однако одного лишь квантования по уровню для этого недостаточно – для преобразования в цифровую фор

На этом алгоритме построена процедура построения оптимального кода, предложенная в 1952 году доктором Массачусетского технологического института (США) Дэвидэм Хаффменом:

5) буквы перви

Рассмотрим алфавит из восьми букв. Ясно, что при обычном (не учитывающем статистических характеристик) кодировании для представления каждой буквы требуется три символа.

Наибольший эффек

Таких параметров 2: коэффициент статистического сжатия и коэффициент относительной эффективности. Оба параметра характеризуют степень уменьшения средней длины кодового слова. При этом средняя длина

5. Букве первичного алфавита с наименьшей вероятностью появления ставится в соответствие код с наибольшей длиной (лемма 1), т.е. такой код является неравномерным (с разной длиной кодовых слов). В р

Лабораторная работа №4 выполняется под управлением специально написанной управляющей программы. Эта управляющая программа написана на языке Visual Basic 6. Исполняемый файл программы носит и

Линейные коды обладают следующим свойством: из всего множества 2k разрешенных кодовых слов можно выделить подмножества из k слов, обладающих свойством линейной независимост

Кодовое слово КС получается путем умножения матрицы информационной последовательности ||X|| на образующую матрицу ||OM||:

||KC1*n|| = ||X

В результате передачи кодового слова через канал оно может быть искажено помехой. Это приведет к тому, что принятое кодовое слово ||ПКС|| может не совпасть с исходным ||КС||.

Лабораторная работа №5, как и работа №4, выполняется под управлением управляющей программы, написанной на алгоритмическом языке Visual Basic 6. Исполняемый файл программы носит имя Помехо

![]() называется скоростью передачи информации по каналу связи. Эта величина равна количеству относительной информации, передаваемой в единицу времени. За единицу времени при дискретном канале связи удобно считать время передачи одного символа. В этом случае в формулах для скорости передачи информации понимают энтропии и количества информации на один символ. Для непрерывных каналов связи используются две единицы измерения или обычная единица (к примеру, секунда), или интервал времени между отсчетами

называется скоростью передачи информации по каналу связи. Эта величина равна количеству относительной информации, передаваемой в единицу времени. За единицу времени при дискретном канале связи удобно считать время передачи одного символа. В этом случае в формулах для скорости передачи информации понимают энтропии и количества информации на один символ. Для непрерывных каналов связи используются две единицы измерения или обычная единица (к примеру, секунда), или интервал времени между отсчетами ![]() , в этом последнем случае в формулах понимаются дифференциальные энтропии на один отсчет (или степень свободы). Нередко в руководствах специально не указывается, какая конкретно из двух единиц применяется. В связи с этим часто используют другую формулу для средней скорости передачи информации

, в этом последнем случае в формулах понимаются дифференциальные энтропии на один отсчет (или степень свободы). Нередко в руководствах специально не указывается, какая конкретно из двух единиц применяется. В связи с этим часто используют другую формулу для средней скорости передачи информации![]()

![]()

![]()

![]()

![]()

бит/с. (22)

бит/с. (22)![]() .

(24)

.

(24) ,

,![]() . (26)

. (26)Пропускная способность систем передачи информации

![]()

.

.

![]() ,

,![]()

![]() , .

, .

![]() , [бит/символ].

, [бит/символ].