Эффективное продвижение в Google: методы, которые работают! Поведенческие факторы в выдаче Яндекса и Гугла. Непрямые доказательства влияния поведенческих факторов на ранжирование

Оглядываясь на события прошедшего года, понимаешь, что он стал для большинства оптимизаторов и веб-мастеров очень насыщенным. И если всеми любимая поисковая система Рунета Яндекс вела себя достаточно сдержанно, то Google преподнес несколько значимых “подарков”.

В 2012 году Google, до этого являвшийся “отдушиной” для оптимизаторов, в одночасье превратился из добродушного друга в строгого полицая. Если раньше добиться хороших результатов можно было за счет “продавливания” ТОПа, по большому счету, лишь ссылочной массой, то теперь правила игры изменились. Однако у оптимизаторов есть на руках все необходимые инструменты для эффективного продвижения в данной поисковой системе. Какие именно? Об этом и пойдет речь в моем мастер-классе. Но обо всем по порядку.

Как изменились правила игры

Для начала предлагаю совершить небольшой экскурс в историю. Первые ощутимые трудности при продвижении сайтов в Google начались у западных SEO-специалистов еще в середине 2011 года.

- Всё началось с появления алгоритма под дружелюбным названием “Панда”. Его целью являлось выявление низкокачественного контента, с которым он успешно борется до сих пор. Стоит отметить, что “Панда” пришла в Рунет гораздо позже, и первые трудности у отечественных оптимизаторов начались лишь в начале 2012 года.

- Весной 2012 года компания Google представила новый алгоритм “ ” , который, также как и “Панда”, был направлен на борьбу с поисковым спамом. В отличие от других нововведений, “Пингвин” был запущен одновременно для большинства стран, в том числе и для России.

- 28 ноября 2012 года небезызвестный Мэтт Катс объявил в своем блоге о готовящемся новом “EDM-алгоритме” , направленном на борьбу с SEO-доменами (это домены с прямым вхождением поискового запроса, как, например, plastikovie-okna-v-moskve.ru). После появления первой информации о запуске “EDM” многие оптимизаторы и владельцы SEO-доменов заметили значительное снижение трафика на их сайты.

Как мы видим, прошлый год оказался крайне насыщенным на события. Конечно, основные принципы продвижения в поисковой системе Google, по сути, не изменились. Все те инструменты, которые ранее давали результат, работают до сих пор, вот только качеству этих инструментов сейчас придается особое значение. На сегодняшний момент для эффективного продвижения в Google стоит работать по трем ключевым направлениям:

- Плавное наращивание ссылочной массы.

- Написание качественных и, что самое главное, продающих текстов.

- Работа с “кликовыми” поведенческими метриками.

Далее давайте рассмотрим ряд кейсов из моей практики, которые наглядно иллюстрируют то, как, используя озвученные выше методы, я справился с последствиями нововведений Google, а теперь работаю над увеличением пресловутой отработки (повышением % запросов в ТОП 10, которые достигли своей цели).

Примеры из жизни

Ввиду соглашения с клиентами о неразглашении информации, данные, представленные ниже, были обезличены. Итак, поехали:

Проект 1: возраст 3 года 8 месяцев, активно продвигается последние 18 месяцев. Это один из тех сайтов, который на себе ощутил удары новых алгоритмов и :

Как видно из графика, после запуска “Пингвина” (24-26 апреля) позиции данного сайта существенно просели. Помимо этого, в мае и июне наблюдалась тенденция к уменьшению % выведенных в ТОП запросов. Однако, начиная с июля, после того, как были проанализированы обратные ссылки и качество текстов, а также проведены соответствующие работы, стала проявляться положительная тенденция к росту. На сегодняшний день проект полностью оправился от падения, Google восстановлен и даже увеличен за счет повышения количества запросов, находящихся в ТОП 10.

Проект 2: возраст 2 года 5 месяцев, продвигается последние 2 года. Сайт получил штрафную карточку от Google после запуска “Пингвина”. Для сравнения ниже приведены данные по отработке проекта в обеих поисковых системах:

Как видно на графике, Проект 2 также получил пенальти от Google, однако при этом видимость сайта в поисковой системе Яндекс осталась на прежнем уровне. Отчасти это позволило минимизировать потери в трафике, поскольку в случае с данным ресурсом распределение трафика из поисковых систем выглядит следующим образом: Яндекс — 70%, Google — 30%. Тем не менее, работа над ошибками также была оперативно проведена, после чего позиции сайта восстановились.

Проект 3: молодой сайт, возраст 5 месяцев, продвижение проекта ведется с запуска ресурса.

Это наиболее интересный проект с точки зрения инструментов, которые использовались при продвижении. На его примере отчетливо видно, как плавно наращиваемая вкупе с качественным контентом показывают хороший результат. Стоит сделать оговорку: хотя ссылочная масса по большей части игнорирует тематику продвигаемого ресурса, но ввиду молодости сайта, ссылки закупались только с качественных и проверенных на других проектах донорах.

Отмечу, что, как показывает практика, в 90% случаев то, что хорошо для Google, хорошо и для Яндекса. Разумеется, рост позиций в главной поисковой системе Рунета не такой “взрывной”, как в Google, но он есть. Однако это уже совсем другая история, которую, в свете запуска новой , оставим для следующего мастер-класса.

Как достичь хороших результатов

Наверняка у вас мог возникнуть вопрос: “Как добиться хороших результатов или вернуть утраченные позиции в Google?” . Ответ прост: нужно количество превратить в качество . Бездумный подход, который раньше работал в подавляющем большинстве случаев, теперь не пройдет. Безусловно, и сейчас можно встретить индивидов, которые пытают продвигать свои проекты “по-старому”, но результат в большинстве таких случаев попросту отсутствует.

Как я уже писал выше, в настоящий момент в Google на первый план вышли контент, грамотная работа со ссылочной массой и . Далее я постараюсь максимально подробно рассказать про каждую из этих составляющих.

1. Контент. Ни для кого не секрет, что после запуска алгоритма “Панда” зарубежные оптимизаторы стали уделять большое внимание качеству контента на своих сайтах. Как показало время, наполнение сайта уникальной и полезной информацией дает положительный эффект в долгосрочной перспективе как в плане SEO, так и в плане маркетинга и рекламы в целом.

Как создать качественный текст, который заинтересует не только посетителей, но и роботов поисковых систем?

Все достаточно просто, и ниже я постараюсь описать по пунктам, чем стоит руководствоваться SEO-специалистам при составлении технического задания (ТЗ) копирайтерам на написание текстов:

- Анализ конкурентов по поисковой выдаче . На этапе составления ТЗ копирайтеру стоит в первую очередь смотреть на сайты конкурентов. Основными критериями для оценки являются:

- Размер текста . Исходя из данных о конкурентах, определяемся с минимальным и максимальным размером текста и, основываясь на принципах здравой логики, определяемся с объемом для своего текста. По своему опыту могу сказать, что не нужно стараться писать “простыни” — в 99% случаев для донесения всей необходимой информации хватает 2000-2500 символов. В конце концов, поставьте себя на место пользователя и подумайте, стали бы вы сами читать многостраничный текст о том, как хорошо “купить пластиковые окна в Москве”.

- Количество вхождений фразы в текст . Проверяем количество точных вхождений и вхождений в словоформы ключевой фразы (например, “пластиковые окна”) в текст. По-отдельности для каждого слова, т.е. для слов “пластиковые”, “окна” и производных от них, мы смотрим на количество вхождений в текст. На основании полученных данных вычисляем максимальную плотность фразы и её отдельных слов.

- Количество вхождений фразы в h1- h3 . Здесь все просто — смотрим на количество точных вхождений ключевой фразы в тегах h1-h3 в тексте.

Анализ текстов на страницах конкурентов можно провести в сервисе Rookee абсолютно бесплатно:

- Естественность текстов . Оцениваем естественность текстов на страницах сайтов конкурентов. Для этого можно также использовать анализ в сервисе Rookee:

Чем значения столбцов ближе к идеальному значению, тем лучше. В приведенном примере текст не совсем естественный, и, как минимум, я бы на порядок сократил количество вхождений со словом “шина”.

- Польза . Не стоит делать контент ради контента, всегда при его создании думайте о пользе для своих посетителей. Если же контент создается только ради позиций, то лично я считаю, что такой текст лучше в принципе не писать. Не будьте “just another one”, будьте лучшими!

Итак, после того, как текст готов, оцениваем его качество и, если оно нас устраивает с точки зрения конечного пользователя, то проверяем его на естественность инструментами, озвученными выше.

Обращаю внимание на то, что ключевую роль в цепочке “SEO-специалист —> текст” обычно играет копирайтер. Поэтому, если вы не уверены в качестве работы копирайтера или не знаете, где найти толкового специалиста, могу посоветовать заказать .

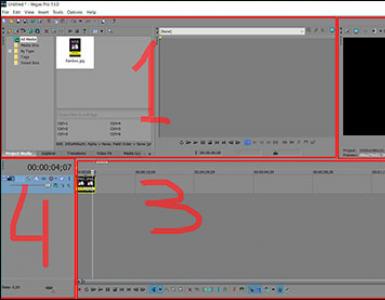

2. Работа со ссылочной массой . Для начала давайте вспомним, как ещё год назад осуществлялось продвижение в Google. Примерно это выглядело так:

1. идем на биржу или обращаемся в сервис по продаже ссылок,

2. покупаем “over 9000” ссылок на свой сайт,

4. получаем результат!

Наверняка, кто-то из вас узнал в этом и себя. Что же сейчас? В существующих реалиях такой подход если и дает эффект, то очень непродолжительный и крайне ненадежный.

Вот два мифа, которые появились в среде оптимизаторов после выхода “Пингвина”:

- Влияние тематики на связку донор — акцептор . Факт в том, что в российской версии Google роль тематики сильно преувеличена. Если посмотреть первые 10 результатов по любому коммерческому запросу и проанализировать обратные ссылки, стоящие на сайты из ТОП 10, то в подавляющем большинстве случаев мы увидим ссылки с нетематических площадок, которые, тем не менее, хорошо работают.

- Точное вхождение ключевой фразы в анкоры . Есть мнение, что большое количество точных вхождений ключа в анкоры ссылок негативно сказывается на позициях. Не сказывается — проверено. Грамотное использование анкоров с точным вхождением, точным вхождением с окружением и точным вхождением с разбавлением позволяет избежать переспама анкор-листа и получить стабильный рост позиций. Но зацикливаться именно на этих типах анкоров не стоит — импровизируйте! К слову, если вы продвигаете сайт в сервисе Rookee, вы можете выбрать стратегию продвижения именно под Google и самостоятельно настроить генерацию текстов ссылок:

В идеале, для достижения положительных результатов нужно плавно наращивать ссылочную массу. Необходимо, чтобы картина прироста ссылочной массы была максимально равномерной и продолжительной по времени. У большинства моих проектов график прироста ссылочной массы выглядит примерно так:

Еще один важный момент, который стоит учитывать для получения от Google максимальной отдачи: не сосредотачивайте всю ссылочную массу только лишь на продвигаемых страницах — для поисковых систем это выглядит неестественно.

Если показать наглядно, то не советую делать так :

Старайтесь делать так:

- Поведенческие факторы (ПФ) . О ПФ и их влиянии на результаты поиска мы привыкли говорить в контексте поисковой системы Яндекс. Но не стоит забывать, что Google тоже использует ПФ при ранжировании сайтов в поисковой выдаче. Немаловажную роль здесь играет показатель CTR (кликабельности) ссылки в поисковой выдаче. К примеру, запрос с CTR 10% стабильно держится в ТОП 3 поисковой выдачи:

А вот запросу с CTR, равным 1%, пока только предстоит побороться за внимание пользователей в поисковой выдаче:

Если мы говорим о CTR ссылки на наш сайт в поисковой выдаче, то стоит упомянуть, что на кликабельность прямо влияет качество самого сниппета. Мне всегда очень нравилось, как выглядят сниппеты SEO-компаний в украинской выдаче Google. Многие методы, которые используют украинские специалисты, можно и нужно использовать для повышения CTR своего сайта в выдаче. Для наглядности приведу несколько наиболее интересных, на мой взгляд, примеров, взятых из выдачи (Google, Киев):

Чтобы сделать для своего сайта такой же выделяющийся сниппет, достаточно добавить в текст description специальные символы. Открываем таблицу спецсимволов HTML (ее можно найти в интернете) и, используя их, составляем красивый и выделяющийся description для своего сайта.

2.

В данных сниппетах используется несколько техник:

- Сниппет №25 — рейтинг и количество отзывов реализовано с использованием микроформатов, их еще называют “микроразметкой” (прочитать про нее можно в справке Яндекса).

- Сниппет №26 — URL украшен спецсимволами и аватаркой автора из Google+. Чтобы добавить в сниппет аватарку из G+, достаточно вставить ссылку на свой аккаунт в формате текст_ссылки. Спецсимволы в ссылке на страницу реализованы через связку “микроформат + спецсимволы HTML”. Если посмотреть код страницы, то мы увидим следующую конструкцию:

Опять же, если вы хотите получить такую же красоту, то читаем справку по микроформатам, ссылку на которую я уже приводил выше.

Исходя из своего опыта, могу посоветовать всем читателям работать над своими сниппетами — использовать представленные выше техники и придумывать свои. К примеру, спецсимволы можно указывать и в теге Title — это тоже будет способствовать улучшению кликабельности сниппета в выдаче поисковой системы Google. Улучшая CTR сниппетов, вы будете в конечном счете улучшать и кликовые поведенческие метрики, что в конечном итоге положительно отразится и на росте позиций в поиске.

В заключение статьи я хочу сказать, во-первых, надеюсь, что данный материал был вам полезен. Во-вторых, надеюсь, что мне удалось развенчать некоторые мифы об агрессивности поисковой системы Google по отношению к SEO-специалистам. Используя информацию из данного мастер-класса, вы точно сможете эффективно продвигать свои ресурсы в Google.

Успехов и максимально быстрой дороги к ТОПу!

Здравствуйте, уважаемые читатели блога сайт. Сегодня будет статья на тему, о которой говорят уже все кому не лень — поведенческие факторы. На самом деле уже многие в курсе что это такое, да и я сам около полугода назад писал о пользовательских характеристиках, как одном из трех китов, на которых стоит продвижение сайтов в современных условиях.

Особенный резонанс влияние поведенческих факторов, а точнее их накрутка, получили в последнее время. Яндекс с конца мая начал пессимизировать ресурсы, использующие различные способы накрутки поведения пользователей на сайте. Причем, все это было сделано с большой помпой, под горячую руку попало очень много ресурсов и в том числе лидеры области . Все это получило большую общественную огласку (ролик в новостях по ТВ, статья в ведомостях, масса публикаций и обсуждений в интернете).

Поведенческие факторы — история появления

Т.е. Яндекс сотворил эдакую показательную порку всех тех, кого ему далось поймать за руку на накрутке поведенческих факторов продвижения (а с точки зрения поисковых систем — документов ). Понятно, что как только оптимизаторы поняли, что за накрутку поведения посетителей можно , то тут же стали пытаться завалить таким не хитрым способом своих конкурентов.

Вроде бы как даже всего нескольких оплаченных, например, в юзаераторе (один из многочисленных сервисов предлагающих услуги накрутки пользовательских характеристик) кликов по сайтам конкурентов из поисковой выдачи Яндекса было достаточно для того, чтобы отправить этого конкурента под фильтр. В результате, по тем запросам, по которым продвигался данный ресурс с помощью накрутки ПФ, он резко выпадал за Топ 100.

Наверное, большинству из вас, уважаемые читатели, понятно, что до бесконечности так продолжаться не могло и сейчас поисковик номер один в рунете уже не наказывает за подобную накрутку, но это вовсе не значит, что теперь все могут бросать это делать. Скорее всего у Яндекса сейчас работает алгоритм, который просто нивелирует (обнуляет) влияние накрутки, тем самым полностью сводя на нет результат от этого способа продвижения.

Но давайте вернемся к тому, что такое поведенческие факторы, на какие группы они подразделяются, какие способы накрутки ПФ существовали (и продолжают существовать, но уже не будут иметь такой сумасшедшей популярности), как Яндекс, да и мы с вами, можем определить, что на ресурсе проводилась накрутка ПФ, и какие существуют «белые» способы улучшения влияния ПФ на продвижение ().

Итак, откуда и когда именно появилось понятие пользовательских факторов , и какая из поисковых машин стала его первой использовать? Кто-то считает, что еще в 2004 году после появления алгоритма Флорида в Google (сейчас текущий алгоритм уже называется Панда) эта поисковая система стала активно учитывать ПФ на ресурсе, и именно тогда произошло проседание многих искусственно накрученных и накачанных ссылками сайтов.

Также достоверно известно, что не безызвестная компания Микрософт (имеющая непосредственно отношение к ) в 2008 опубликовала документ , поясняющий принцип работы такого показателя как Browserank, который судя по опубликованному документу должен был стать гораздо более эффективным инструментом, чем разработанный гораздо раньше всем вам известный .

Если обобщать, то Browserank в какой-то степени является аналогом pagerank, но при этом вес отдельных документов в сети оценивается не по проставленным ссылками, а по конкретным осуществленным переходам по этим ссылкам , т.е. по кликам. При использовании Browserank гораздо более высокие позиции в поисковой выдачи должны были получить сайты социальных сетей и других ресурсов, где пользователи проявляют большую активность (кликают).

Ну, и относительно недавно об учете пользовательских характеристик заговорил и Яндекс. Так почему же всем без исключения поисковикам, которые хотят иметь актуальную и релевантную выдачу, нужно учитывать ПФ? Наверное, просто потому, что два других основных фактора, на которые обращали поисковики свое внимание при ранжирования документов, уже себя изжили. Я говорю об анализе непосредственно контента документа и анализа проставленных на этот документ ссылок.

Нет, конечно же, текст и ссылки по-прежнему влияют на ранжирование, но они уже не могут оказывать решающего влияния из-за того, что сильно дискредитированы, попросту заспамлены . Сначала оптимизаторы (вот, гады) заспамили тексты и все те факторы текстовой оптимизации, на которые обращали особое внимание поисковые системы ( в заголовках, тегах выделения, мета тегах и т.п.).

А потом эти самые оптимизаторы (чтоб им) заспамили и ссылочные факторы, на которые поисковики поначалу возлагали очень большие надежды, ибо текст оптимизировать совсем не сложно, а вот ссылки на себя проставлять ведь нужно с других ресурсов, что значительно сложнее.

Но данную проблему решили биржи ссылок, например:

- МираЛинкс описанный

- ГоГетЛинкс — читайте о нюансах работы с ним

- ГетГудЛинкс — описание возможности по покупке ссылок со страниц имеющих PR (большой статический вес)

- РотаПост — полный обзор возможностей биржи

Они стали посредниками между теми, кто желал продажей ссылок со своего сайта, и теми, кто желал получить преимущество в продвижении, купив нужное количество бэклинков с нужными анкорами.

Теперь использование ключевых слов, по которым продвигается ваша статья (), стало равнозначно тому, как будто бы вы сами сообщили поисковику (в письменной форме) о том, что данные ссылки являются покупными. Нет, конечно же, они хоть и знают, что ссылка покупная, но все равно могут ее учитывать, но встает вопрос, а насколько учитываются они при ранжировании.

Для некоммерческих поисковых запросов велика вероятность того, что покупная ссылка (с оптимизированным анкором) вообще учитываться не будет, а вот для коммерческого запроса эти ссылки по-прежнему работают, но с такими большими оговорками, что, пожалуй, вам никто не даст точного ответа как именно. Все оптимизаторы покупают бэклинки, но многие уже начинают улучшать не покупкой дополнительных ссылок, а, наоборот, снятием заведомо плохих. Вот как извратили такую хорошую идею.

В общем, Яндекс и Гугл по-прежнему учитывают оптимизированность текстов и проставленные обратные ссылки, но уже с очень и очень большим количеством оговорок. И тут как раз очень кстати пришлись поведенческие факторы.

Если попробовать проследить за поведением пользователей в выдаче, а так же на сайтах (страницы которых должна ранжировать поисковая машина), то можно при должном умении извлечь из этого очень много полезной информации, позволяющей лучше настроить ранжирование по всем запросам и получить выдачу еще более релевантную им.

Получается своеобразная обратная связь , когда сами посетители своими действиями подтверждают или, наоборот, опровергают право нахождения данного ресурса на данной позиции в поисковой выдаче.

Но тут опять же все не «здорово живешь». Во-первых, снова возникает угроза того, что пользовательские факторы очень быстро заспамят (что, собственно, и происходит), а во-вторых, нужно не просто собрать информацию о поведении посетителей и в поисковой выдаче (для поисковиков это не проблема), и на самих пользовательских ресурсах (где им статистику собрать сложнее, но тоже можно), а еще ее и интерпретировать либо в плюс, либо в минус.

Но давайте обо всем поговорим по порядку и попробуем разложить информацию по полочкам.

Расчет поведенческих факторов в выдаче и на сайте

Итак, давайте подумаем, на что и где именно могут обращать внимание поисковики при анализе ПФ. Вообще принято считать, что они отслеживают поведение пользователей в двух основных местах:

- в своей собственной поисковой выдаче

- на ранжируемых сайтах

Давайте посмотрим, на что могут обращать внимание поисковые системы при учете поведения пользователей в поисковой выдаче :

Как поисковики узнают о поведение людей на сайте и на что смотрят

Понятно, что из своей собственной выдачи и Яндекс, и Google смогут вытянуть всю необходимую им информацию о ПФ, но вот непосредственно на пользовательских проектах у них такой власти уже нет. Но тем не менее поисковые системы с успехом решают данную задачу, а значит мы сможем предположить как это им удается.

Итак, как же Яндекс и Google смогут оценить поведение пользователей на вашем сайте :

- обладает богатейшим функционалом и при этом является бесплатным. Никогда не задумывались, зачем его разработчикам быть столь щедрыми? Да просто они получают в случае установки их счетчика на сайт всю необходимую им информацию для ранжирования ресурса, опираясь на поведенческие факторы. Это вполне логично.

- Довольно не сложно продолжить логическую цепочку и прийти к выводу, что, скорее всего, такие приложения для как , панель Google или та же способны собирать нужные данные о поведении посетителей на ресурсах, которые те (в смысле «обаренные» пользователи) посещают.

- Вы, наверное, все знаете, что в интернете, и в частности в рунете, существует масса бесплатных сервисов, предоставляющих свои счетчики посещений. А какая им выгода от того, что вы поставите на свой проект их скрипт? Обратная ссылка? Возможно, но слишком мелко. Тут, наверняка, есть более заманчивые варианты. Если у одного игрока интернет бизнеса есть то, что нужно другому, то они завсегда смогут договориться об обоюдной выгоде:

- — есть мнение, что сливает за денежку набранную Яндексу

- — судя по тому, что , то и в области учета поведенческих факторов при ранжировании у них возможно такое же тесное сотрудничество

Наверное, можно и еще чего-нибудь придумать, но и этого вполне хватает, чтобы понять, что поведение посетителей на любом ресурсе рунета для Яндекса (и Гугла) в той или иной степени не будет являться секретом.

Но ведь пользователи это не асессоры Яндекса, которым специально платят зарплату за то, чтобы они давали оценки веб проектам по целому ряду позиций. Им денег никто не платит и то, как понимать их действия, Яндексу придется как-то решать самому, используя логику и силу программистской мысли.

Причем, один и тот же показатель поведенческих факторов для ресурсов разных тематик может означать в одном случае хорошо, а в другом — не очень.

Так, а теперь давайте подумает, какие ПФ на сайте могут учитывать поисковиками:

- Ну, наверное, учитывается много факторов, но наверняка такая характеристика, как показатель отказов , будет учитываться обязательно. Показатель отказов показывает отношение сессий с единичной глубиной (точка входа совпадает с точкой выхода) к общему числу сессий. Если вам это не очень понятно, то обязательно ознакомьтесь со статьей о посещаемости сайта (ссылка на нее была приведена чуть выше), где все это очень подробно разжевано.

- Думаю, что при анализе поведенческих факторов поисковиками учитывается также и продолжительность сессии — время, проведенное посетителем на сайте, пока он не сделал перерыва в открывании страниц более 30 минут или не закрыл браузер.

- Ну и глубина сессии (сколько страниц просмотрел пользователь за одну сессию) по всей вероятности тоже должна приниматься в расчет.

- Так же, на мой взгляд, поисковики должны учитывать объем и, что более важно, источники трафика на сайт. Другими словами, лучше будет, если посетители на ваш проект будут приходить не только с выдач поисковиков, но и из других источников, как, например, закладки браузера, социальные сети и т.п.

Анализ пользовательских факторов и способы их улучшения

Если с последним пунктом все ясно, то вот по первым трем такой ясности и однозначности нет. Судите сами, у интернет магазина (а еще даже лучше для примера подойдут доставка пиццы или заказ такси) может быть очень короткая сессия и показатель отказов близкий к ста процентам (посетитель зашел на страницу, увидел номер контактного телефона и ушел звонить), но тем не менее сам интернет магазин может быть очень хорошим и будет хорошо ранжироваться в Яндексе.

Для новостного же портала или блога, подобного тому что вы сейчас читаете, показатель отказов в 100% (ваш ресурс пользователям, скорее всего, не интересен) или даже в 90% будет катастрофой, которая лишит его львиной доли трафика с поисковых систем.

Т.е. ПФ учитываются Яндексом и другими поисковиками сугубо избирательно. Видимо существуют определенные срезы сайтов по тематикам , для которых у Яндекса есть усредненные показатели поведенческих факторов и с которыми будут сравниваться все другие ресурсы отнесенные к этому же срезу.

Т.е. слишком низкий показатель отказов для магазина по доставке пиццы может быть интерпретирован поисковиками как не очень положительный ПФ (пользователи слишком долго ищут нужный им телефон для заказа), и возможно что позиция этого ресурса будет несколько скорректирована в худшую сторону. Но думаю, что по одному единственному поведенческому показателю такое решение вряд ли будет выноситься.

Как узнать, какие значения ПФ будут нормальными именно для вашего ресурса ? У Гугла есть масса полезных сервисов, которыми мало кто пользуется, например, все тот же DoubleClick Ad Planner, который я толком и не понимаю для чего нужен, но вот его данные могут нам пригодиться в оценке пользовательских факторов собственного проекта.

Введя на этой странице (для входа на нее нужно иметь ) в поле «Просмотреть данные о сайте» URL своего ресурса, вы получите массу полезной информации о своем веб проекте. В области «Статистика по трафику» в двух самых нижних строчках вы как раз и увидите ваши пользовательские характеристики:

Надеюсь, что вы знаете другие ресурсы в вашей тематике, с которыми можете сравнить имеющиеся у них и у вас поведенческие факторы. Я, например, сравнил свой блог с проектом Михаила Шакина, который имеет по мнению DoubleClick Ad Planner такие ПФ:

Если вы таких ресурсов не знаете, то посмотрите что вам присоветует сам Ad Planner в области «Также посещенные сайты». Как бы это один из, наверное, многих способов проверки соответствия ваших поведенческих факторов стандартам принятым в вашей нише.

Теперь еще осталось сказать пару слов про белые способы улучшения пользовательских характеристик для своего сайта:

- Не устаю приводить в пример Михаила Шакина — он уже года три как использует очень хороший способ увеличения продолжительности сессии (времени проведенного пользователями на его блоге). Наверное, и сами уже догадались? Я говорю про видеоролики в конце каждого его поста. Очень хорошая идея, ведь недаром Михаил уверено ориентируется в буржуйском SEO, которое несколько опережает Сео рунета.

- Второй способ подольше удержать пользователей на своем сайте — это создание какого-то интересного или полезного сервиса, который может занять ваших посетителей на некоторое время. Чего именно стоит сделать зависит, наверное, от тематики вашего ресурса. У меня лично никаких идей по этому поводу для своего блога нет, а жаль.

- Наверное, самый избитый совет, который дают все по поводу улучшения поведенческих факторов, это поработать над (удобством пользования вашим ресурсом). Что тут сказать? Дело это не просто сложное, а очень и очень сложное, так что каждый решает его по мере своего умения.

- Также очень не плохо будет понять, что попытка продвижения по тем поисковым запросам, которые не полно отражены на страницах вашего ресурса, может привести только к ухудшению пользовательских факторов . То, что попало в выдачу поисковиков случайно, само по себе отсеется (пользователи проголосуют за это высоким показателем отказов и короткой сессией), но делать это специально не стоит.

- Для лучшей оценки вашего сайта поисковыми системы с точки зрения поведения посетителей, вам нужно будет сформировать костяк своей постоянной аудитории ( вам в руки, ну или ) или же стараться постоянно получать поток посетителей с источников отличных от поисковых выдачи ().

- Такая безобидная с виду вещь, как часто встречающиеся , может служить мощнейшим стимулом для проседания поведенческих характеристик ранжирования. Раздражает это многих. Увы и ах, но такие патологически безграмотные типы, как я, вынуждены прибегать к различным онлайн способам проверки орфографии до и после публикации статьи на блоге.

- , как ни банально и не избито это звучит, влияет в итоге на посещаемость вашего проекта. Поисковикам до лампочки, почему именно посетители сразу покидают ваш проект так ничего не нем и не посмотрев. Это может быть плохого качества SEO контент, а может быть пауза в несколько секунд, которая сопровождает открытие каждой его страницы.

Запрещенные способы и методы накрутки ПФ

Так, а теперь давайте посмотрим, какие такие накрутки поведенческих факторов занимали умы многих оптимизаторов и оптимизаторских контор до недавнего времени. Насколько я понимаю, накручивали именно поведение в поисковой выдаче Яндекса, а не непосредственно на сайте.

Причем, можно выделить два вида накрутки :

Накрутка ПФ через ботнет, т.е. через сеть зомбированных вирусом компьютеров по всему миру. Владельцы компьютеров зараженных вирусом при этом обычно ничего не замечают и спокойно шарятся по интернету, а скрипт вируса заходит в выдачу Яндекса по нужному запросу и осуществляет от имени этого пользователя переход на нужный сайт.

Что примечательно, данный вирус еще умеет подменять рекламные объявления на ресурсах, по которым ходит владелец зараженного компьютера на другие (заказанные). Но это только по слухам (читайте про мою эпопею ). Вообще, ботнет — это уже уголовно наказуемое преступление, а сотрудничество с его хозяином, наверное, равносильно скупке краденного. Собственно, сам Яндекс говорит о том, что за такой способ накрутки (равно как за другие) он будет наказывать.

Накрутка поведенческих факторов вручную за счет армии не шибко дорогих кликеров из бирж подобных юзератору. Т.е. оптимизатор давал задание набрать в поисковой строке Яндекса определенный запрос, а затем перейти со страницы открывшейся поисковой выдачи на нужный сайт.

На первый взгляд такой способ может показаться очень даже приемлемым, ибо получается дешево и сердито, а связать клики совершенно различных (физических) пользователей с юзератором или другим сервисом накрутки, казалось бы очень сложно. Но это только казалось.

Собственно, даже не нужно быть Яндексом, чтобы понять, что, например, самый известный из зафильтрованных проектов Megaseo накручивал ПФ. В общем-то, они и сами это признали, но тем не менее достаточно зайти на Alexa (кстати, Alexa появился даже раньше Гугла, хоть и не стал столь успешным) и перейти на страницу с данными по Megaseo:

Http://www.alexa.com/siteinfo/megaseo.ru

Переходите на вкладку «Clickstream»:

И видите следующую картину:

Как объясняют знающие люди, выделенный на скриншоте домен является персональным сервисом накрутки, на который могли попасть только пользователи зарегистрированные в Megaseo. Возможно именно поэтому получилось так, что «уши из под шапки видны».

Немного поясню по последнему скриншоту. В верхней табличке приведены ресурсы, с которых люди чаще всего заходили на Megaseo, а внизу, на которые посетители чаще всего уходили с этого зафильтрованного оптимизаторского ресурса.

В общем-то, если уж обычные смертные с их куцыми способами и средствами способны заподозрить что-то неладное, то что уж говорить про Яндекс. Он все знает и все видит. И в общем-то, он показательно дал сильную затрещину самым зарвавшимся накрутчикам ПФ, а дальше он, скорее всего, вообще перестанет учитывать подобные вещи (т.е. будет обнулять влияние накрутки поведенческого ). Иначе в юзераторе конкуренты начнут заказывать друг друга на попадание под фильтр.

В довершение хочу привести видео по теме использования поведенческих факторов в продвижении сайтов рунета — психология поведения пользователей на сайте :

Удачи вам! До скорых встреч на страницах блога сайт

посмотреть еще ролики можно перейдя на");">

Вам может быть интересно

Контент для сайта - как наполнение уникальным и полезным контентом помогает в современном продвижении сайтов

Контент для сайта - как наполнение уникальным и полезным контентом помогает в современном продвижении сайтов

Релевантность и ранжирование - что это такое и какие факторы влияют на положение сайтов в выдаче Яндекса и Гугла

Релевантность и ранжирование - что это такое и какие факторы влияют на положение сайтов в выдаче Яндекса и Гугла

Как ключевые слова влияют на продвижение сайта в поисковых системах

Как ключевые слова влияют на продвижение сайта в поисковых системах

Всем-всем привет!

При ранжировании в поисковой выдаче Яндекс да и любой другой поисковик учитывает массу вещей, в том числе и поведенческие факторы (ПФ). Давайте попробуем разобраться в их влиянии на продвижение в поисковых системах. Погнали!

Поведенческие факторы — это показатели того, как ведут себя пользователи на Вашем веб-ресурсе. А если быть точным, то:

- Сколько времени проводят на сайте;

- Какой ;

- Какое количество страниц просматривают при посещении;

- Как взаимодействуют с различными элементами сайта;

- Ну и много других факторов.

Все это учитывается поисковыми системами и впоследствии применяется для ранжирования сайтов в выдаче: чем лучше ПФ, тем выше позиции сайта. Ведь Яндекс и Google в последнее время делают акцент именно на полезность выдачи для своих пользователей.

Каким образом ПС черпают данные о поведении пользователей?

Для того, чтобы передать Яндексу данные о своих посетителях, достаточно просто . А Вы думали почему она бесплатна? Точно такая же ситуация происходит и в Гугле, только с .

Конечно, полагаться исключительно на системы аналитики ПС не могут, поэтому существует еще несколько способов, благодаря которым они узнают поведенческие факторы сайта:

- Браузеры. В настоящее время о конфиденциальности можно забыть, так как каждый браузер может передавать информацию о Вас поисковым системам. А браузеры от Яндекс и Google: Яндекс.Браузер и Chrome, соответственно, передают еще больший массив данных о Вас;

- Специальные расширения для браузеров. Наверное, у всех есть предустановленные дополнения от популярных поисковиков, например, почтовый клиент. Они также могут собирать информацию о поведении пользователей;

- И еще много-много способов получить интересующие ПС данные.

Таким образом получается, что все мы пропалены безбожно, от чего жизнь SEO-оптимизатора становится только сложней. Ведь поисковики ставят пользователя во главу, а значит и все сайты, представленные в выдаче, должны быть сформированы так, чтобы он получил максимально полный ответ на свой вопрос с удобством.

Продвижение поведенческими факторами

Давайте подумаем о том, как поведенческие факторы влияют на позиции сайта в выдаче. Итак:

Поисковая система имеет какие-то данные о каждом сайте, среди которых представлен Ваш, по определенному запросу. Вы находитесь на 9 позиции, а главный конкурент на 3-й. Ваша задача: войти в ТОП-3.

Для выполнения своей задачи Вы наняли копирайтера с высоким уровнем текстов и заполнили свой сайт контентом. Причем сделали это так, чтобы пользователь получил максимально разжеванный ответ на свой вопрос. На страницу по этому определенному запросу льется трафик, однако если Вы займете ТОП-3, то получите еще больше посещений.

Страница же главного конкурента уступает по качеству материала Вашей и пользователь, перешедший на нее не получает должного ответа и не задерживается там дольше полутора минут. Тогда как посетители Вашей страницы находятся на ней чуть ли не на две минуты больше, да еще и проявляет активность в виде переходов по различным ссылкам. Поисковая система это заметила.

Как Вы думаете что произойдет дальше? Коль Ваша страница более пользователя и дает более исчерпывающий ответ, от чего он задерживается надолго, по сравнению с главным конкурентом, Вы займете более выгодную позицию, а конкурент будет опущен вниз.

Из вышеизложенного примера можно сделать вывод: для того, чтобы иметь хорошие позиции в ПС, нужно делать сайт, исходя из потребностей пользователей. То есть веб-ресурс должен быть удобным для взаимодействия и полезным . Именно на этом строится принцип продвижения поведенческими факторами.

Однако из-за такого механизма работы поисковых систем появился один коварный «черный» — накрутка поведенческих факторов.

Накрутка поведенческих факторов

Данный метод в свое время был очень популярным среди SEO-оптимизаторов, так как имел высокую эффективность. Но вскоре ПС просекли этот тренд и выдвинули ответные меры на подобное баловство в виде фильтра за накрутку поведенческих факторов.

Принцип работы метода таков:

- Вы регистрируетесь в сервисе накрутки ПФ;

- Выбираете способ: нагнать роботов или реальных людей;

- Затем Вы чувствуете планомерное улучшение поведенческих;

- ПСки это тоже видят и повышать Вас в выдаче.

На первый взгляд все просто, однако фильтр быстро вычисляет все это действо и дает жесткое наказание. А вычисляет он это так:

Для роботов, то есть автоматической накрутки ПФ, свойственны схожие IP-адреса, схожие браузеры, схожие устройства, схожее поведение. За счет сопоставления всех данных о посетителях, фильтр выявляет данное преступление и наказывает.

Если же Вы решили нагнать реальных людей, то есть воспользоваться ручной накруткой, то фильтр может вычислить это по истории взаимодействия с поиском того человека, который заходит на Ваш сайт. Не будет же нормальный пользователь за один день интересоваться автомобилями, кулинарными рецептами и IT-технологиями или чем-нибудь еще.

Поэтому опытные веб-мастера не советуют прибегать к подобным услугам, ведь гораздо лучше улучшать поведенческие факторы сайта естественными способами.

Как улучшить поведенческие факторы?

Существует несколько «белых» способов улучшения ПФ:

- Грамотная ;

- Наполнение сайта полезным, интересным и исчерпывающим материалом. Для этого подойдет, как

В этот раз я спросила мнение известных SEO-экспертов Рунета на очень актуальную тему — «Google vs. Яндекс: нюансы SEO под каждую из поисковых систем».

От себя хочу сказать еще такой важный момент — проверяя позиции, не забывайте смотреть релевантные страницы. Это одна из самых частых ошибок — когда в Гугле и Яндексе разная релевантная страница . То есть, вы уверены у себя в голове, что продвигаете главную, а в поисковой выдаче стоит вообще какая-нибудь карточка товара.

В разных ПС также может быть и разный ТОП — страницы немного разного типа. Хотя по опыту, чаще всего ТОП идет более-менее одинаковый. Опять же низкие позиции в поисковых системах часто бывают потому, что под запрос затачивается не подходящая по типу под ТОП страница (главная вместо раздела каталога или статья вместо карточки интернет-магазина).

Если сайт не имеет серьезных технических ошибок, имеет качественный полезный контент, аккуратную, но осознанную оптимизацию и плавно растущую естественную ссылочную массу, обычно он хорошо стоит одновременно в обеих ПС.

И только когда начинается перегиб в попытке повлиять на какой-то фактор — например, массовая закупка ссылок, то сайт может отлично стоять в Гугле, и иметь санкции в Яндексе.

А может плохо стоять в Гугле, если наоборот, мало ссылок, но при этом иметь топовые позиции в Яндексе.

А может вести себя как-нибудь не очень предсказуемо — вроде все хорошо, а в одной ПС стоит хорошо, в другой плохо.

Этим я обычно и занимаюсь во время своих больших аудитов — тщательно проверяю, в чем может быть проблема.

10 известных SEO-экспертов Рунета дали очень много интересных практических деталей, поэтому читайте внимательно, там много полезного!

Сергей Кокшаров

,

SEO-аналитик, автор блога devaka.ru

В Гугле большой упор нужно делать на качество контента и всего сайта в целом. Например, если вы наделали сотню региональных и, практически, одинаковых поддоменов для Яндекса, то не ждите трафика в Google, для него это будет шаблонный контент и авторитет сайта резко снизится.

Также, Гугл меньше приоритета дает скрытому (любым способом) тексту. Этот текст может давать плюсы в Яндексе, но в Google он не будет работать, или даже за него могут наложить фильтр, при наличии в скрытом тексте избытка ключевых слов.

При изменении рейтинга документа, Google использует функцию перехода, которая зависит от ряда внутренних и внешних параметров. Иногда позиции могут резко понизиться, но через неделю выровняться и начать расти. В алгоритмах Яндекса такого нет, и функция перехода всегда скачкообразная. Часто поэтому, оптимизаторы видят разную реакцию поисковиков на изменение одного и того же фактора.

На продвижение сайта влияют присутствие бизнеса в сервисах поисковой системы и в тех сервисах, откуда поисковик берет дополнительные данные (каждый берет из своих мест). Например, Яндекс активно использует данные из Я.Маркета, Я.Справочника, Я.Каталога, бизнес-справочнкика 2GIS и пр.

Что касается ссылок, не забываем, что у Гугла есть Disavow Tool, и вы не знаете, какие свои ссылки отклонил конкурент.

Дмитрий Севальнев

,

евангелист сервиса «Пиксель Тулс»

Основное, что крайне важно осознать, что Яндекс и Google - две разные поисковые машины у каждой из которых:

Своя классификация поисковых запросов.

Свой набор факторов ранжирования.

Свои формулы (для групп запросов).

1. Производить анализ ТОП в заданной поисковой системе. Изначально лучше ориентироваться на ту, которая приведёт больше целевой аудитории в тематике и регионе, а в дальнейшем, опираясь на сайты из выдачи - корректировать факторы под проблемных поисковик.

2. Посмотреть, как классифицирует и расширяет каждая поисковая система запрос? Бывает так, что запрос в Яндексе носит ярко выраженный коммерческий характер (высокая коммерциализация по https://tools.pixelplus.ru/news/kommertsializatsiya) а в Google - показатель низкий.

В этом случае, не исключено, что и целевые URL могут отличаться. Случай экзотический, но реальный.

Особое внимание на переколдовку (расширение) запроса.

3. Для Google - больше точных вхождений, больше сами объемы текстов.

При этом, не забываем про Баден-Баден и прочие текстовые пост-фильтры Яндекса - https://pixelplus.ru/samostoyatelno/stati/tekstovaya-optimizatsiya/tekstovie-filtry-v-yandex.html

4. Для Google - больше ссылок и большее влияние ссылочных факторов на текущее ранжирование.

5. В Яндексе - больший акцент на коммерческие факторы ранжирования: ассортимент, цены, способы связи, информация о компании, корзина.

6. Продвижение в регионах - фундаментальные различия в региональном ранжировании двух поисковых систем отражены на слайде.

7. Важный технический аспект . Google воспроизводит JavaScript на странице и существенно понижает значимость текста, который можно скрыть с его использованием.

В случае, если используются подобные техники для вёрстки текста - важно учесть.

8. Работа с кликовыми ПФ. В Google meta-тег Description активно используются для сниппета, необходимо использовать это.

9. Отличается индекс и его полнота. Если документ проиндексирован в Яндексе, это не значит, что он в базе Google и наоборот. Надо проверять. Аналогично и со ссылочными донорами.

10. Важно установить Google Analytics для корректного учёта внутрисайтовых ПФ.

Общий вывод . Различия в позициях одного и того же сайта в двух поисковых системах, как правило, носят индивидуальных характер. Тем не менее, наиболее частые причины (в порядке убывания вероятности):

Региональность выдачи Google

наличие санкций в одной из поисковых систем

ссылочные факторы

поведенческие факторы (GA и Метрика)

текстовые (морфология)

,

руководитель рекламного агентства SEO Интеллект

А так выглядит посещаемость сайта попавшего под бан за накрутки ПФ:

4. Коммерческие факторы.

В коммерческих тематиках на ранжирование в Яндексе сильное влияет ассортимент. Привилегии в ранжировании сайтов с широким ассортиментом позволяют агрегаторам забивать топы, не пуская туда релевантные документы компаний с узкой специализацией. При этом в Гугл сайты неплохо ранжируются сайты с небольшим ассортиментом. Например, посмотрите на выдачи обоих поисковиков по запросу «сервисные центры».

Красным в таблицах отмечены агрегаторы предоставляющий большой выбор сервисных центров различных брендов. Гугл отдает предпочтение трастовым сайтам отдельных брендов, в то время как Яндексу дает пользователю сайты с широким ассортиментом брендов.

5. Гео факторы.

Ещё одно отличие, которое хотелось бы отметить, это работа с геозависимыми (ГЗ) запросами. Трюк с поддоменами, который можно провернуть в Яндексе, клонировав основной сайт и немного поработав с вхождениями топонимов, позволяет получать локационный трафик в другом регионе, а в Гугл этот прием не работает. Вот так выглядит трафик на региональных поддоменах:

Мы проверяли на очень приличных выборках из тысяч сайтов – в Яндексе Топы, в Гугл Ж*пы.

● Может по-разному оцениваться преобладающий интент запроса, ТОПы зачастую сильно отличаются не только по набору доменов, но и по типам контента. Например, в Яндексе — статьи, в Google — продающие коммерческие страницы. Впрочем, это не общее правило, зависит от тематики.

● Google хуже справляется с русской морфологией. Яндексоиды даже немного подкололи конкурента в одном из своих семинаров. Анализ русскоязычных текстов у Google менее продвинут.

● По Рунету у Яндекса гораздо четче геотаргетинг; при продвижении коммерческих сайтов с геозависимыми запросами необходимо с самого начала обеспечить правильную привязку к региону через Вебмастер, Каталог или Справочник.

● Как минимум до недавнего времени Google гораздо спокойнее относился к обилию прямых вхождений ключа. Но буквально месяц назад ситуация начала меняться, в сентябре был мощный апдейт алгоритма , множество переспамленных страниц ощутимо потеряли в трафике.

Хватает и других мелких различий (отношение к тегу alt изображений, длине title, nofollow-ссылкам, скрытому тексту, rel canonical). Они достаточно легко проверяются по выдаче.

Для практики я не советую заучивать эти или любые другие списки отличий. Факторов много, для разных запросов актуальны разные подходы к продвижению. Составить огромный чек-лист, чтобы последовательно его прорабатывать — плохая идея.

Ага, в гугле проблемы — докупим ссылок. Ой, не сработало. Значит понатыкаем побольше вхождений. Упс, у нас в гостях Минусинск, Баден-Баден и Fred.

Куда разумнее работать с конкретным проектом, его реальной статистикой и конкурентами. Смотрим запросы, которые удалось продвинуть в одном поисковике и не удалось в другом. Изучаем ТОП по ним, ищем отличия наших посадочных страниц от лидеров. Сравниваем динамику посещаемости и позиций у разных url проекта, выявляем удачные документы и закрепляем успех на них. Меняем шаблон вывода контента на паре десятков url, отслеживаем результат. Определяем причины у резких просадок и всплесков трафика. Оцениваем разницу в ранжировании по срезам запросов (например, с вхождением “купить” или “в Москве”). И так далее и тому подобное.

Пара часов ковыряния с панелями вебмастеров и системами статистики даст бездну идей по изменениям на сайте, подскажет компромиссную стратегию для получения максимума трафика из обоих поисковиков. И на деле это проще, чем кажется.

,

основатель агентства REMARKA

,

drmax.su

. Автор учебников SEO-Монстр , SEO-Гуру .

В SEO 13 лет, Опыт работы с буржуями – 7 лет. Крупнейший буржуйский клиент – с годовым оборотом интернет портала в $800.000.000 в год. Работа в 98% под Гугл.

Есть Google, а есть все прочие поисковые системы.

И эти прочие заглядывают в рот Google и перенимают все его технологические достижения. В противном случае они медленно, но верно умирают (Рамблер, Спутник, Yahoo и пр – список мертвых поисковых систем очень велик). Отсюда, если мы сможем продвинуться в Google, с большей долей вероятности, автоматически, мы поднимемся в иных поисковых системах. И даже если у альтернатив есть какие то дыры, давно закрытые у Гугла, и позволяющие манипулировать выдачей, то это не надолго.

Гугл сегодня опирается на 3 базовые вещи: контент, ссылки и алгоритм RankBrain.

Каждая из этих составляющих заключает в себе множество разнообразных факторов ранжирования, в классическом понимании. Более того, есть множество факторов ранжирования, не входящих в эти три группы.

Например, есть корреляция между длинной урла и местом в выдаче – чем короче урл, тем больше шансов проникнуть в ТОП. Что здесь первопричина – а что следствие — не суть важно, возможно, что тут сказывается отношение владельца сайта к серьезности работы над оптимизацией контента, когда он руками прописывает ЧПУ, а не доверяет всяким там плагинам или автоматическим финтифлюшкам генерировать ЧПУ из названия страницы автоматом. Такой товарищ и к подготовке контента и к линкбилдингу будет относиться гораздо серьезней, чем простой блогер.

Итак, контент . Единственное требование к нему – он должен быть полезен. Этого достаточно для признания контента качественным.

Если вы будете писать с ошибками, но при этом 100 000 человек скажут – «фига себе, как же я жил без этого контента до этого», то для продвижения и попадания в ТОП этого будет более чем достаточно. Ибо эти люди сами, без всякой на то просьбы, понаставят ссылок на него, расшарят в соц сети и поделятся со своими знакомыми этим чудо–контентом.

Чтобы контент стал полезен, он должен быть, как минимум, интересен целевой аудитории. При этом, контент не должен быть рерайтом – рерайта, должен давать что-то новое для пользователей. И тут мы автоматом переходим к понятию уникальности. Если вы описываете что-то новое (старыми словами, шутка), то контент и будет уникальным.

Спускаемся ниже в разборе структуры полезного контента. Чем более человек знаком в теме, тем богаче у него профессиональный лексикон. Он на автомате будет вставлять в текст как стандартизированные обороты, так и жаргонизмы, разбавляя и насыщая текст словами – подтверждениями, релевантными терминами (http://drmax.su/klyuchevye-slova-lsi-algoritm.html/). Все это окунает нас в сферу LSI копирайтинга и машинного обучения.

Кроме того, если товарищ ответственно подойдет к работе, создавая полезный контент, он обязательно сопряжет теорию и практику, приведет кучу ярких примеров. Это, непосредственно, скажется на длине контента. Он будет гораздо больше, чем простой текст.

Итак, из простого определения, что КОНТЕНТ ДОЛЖЕН БЫТЬ ПОЛЕЗНЫМ, автоматически вылезли его признаки: он должен быть интересен, уникален, насыщен профессиональными терминами, содержать теорию, практику и примеры, быть большим по объему.

При этом, в обратную сторону – это не работает. Если я напишу 40 000 слов про мутации генов, не обладая при этом профильным образованием и какими — то наработками в этой тематике, даже если я насыщу контент всякими терминами и прочими словоблудиями – ни один товарищ из целевой аудитории не воспримет его как полезный. Никакого профта от такого контента я не получу.

1. Трафик на доноре.

2. Ссылка хорошо вписана в контент статьи — донора, раскрывая, дополняя и поясняя её.

3. Релевантность типа «документ-документ», а не обязательно «сайт-документ». Учитесь писать отличные статьи – прокладки, для размещения своих ссылок.

4. Донор не в ссылочных/статейных биржах. Здесь велик риск получить автоматом падение качества донора и ссылка может стать «ядовитой».

5. Статья снабжена мультимедиа

6. Анкор не спамный (в разрезе всего ссылочного профиля).

Никакие сторонние метрики для определения «качества» донора не нужны. Все эти метрики выдуманы и служат только для набивания карманов, выдумавших эти метрики и продающие подписки на чекалки сайтов на эти метрики. Тут яркий пример такого зомбирования – это MOZ с их показателем DA, без которого большинство западных сеошников не могут судить о качестве сайтов. А стоимость подписки на чекалку этого и иного «синтетического» показателя – посмотрите у них сами.

Аналогично, есть и русские изобретения, не столь дорогие и претенциозные, тот же CheckTrust. Это всего – навсего способ заработка, не самый худший, признаюсь. Ребята – молодцы. Ну а Гуглу – абсолютно наплевать на этот показатель. Он о нем ничего не знает и знать не хочет и на ранжирование этот показатель влиять не может. Есть ли корреляция с показателями качества Гугла, нет ли – никто не знает. А самое главное, это никому не интересно.

Единственная реальная метрика – это количество ключей в ТОПе у донора и отсюда – размер органического трафика. Это «оценку» выставляет сама поисковая система и мы не будем спорить с ней.

Кстати, этот подход сразу выявляет товарищей, не разбирающихся в оптимизации. Если при вас заговорят о всяких там трастах, DA, трастфлов и прочих ТИЦах с мертвыми пейджранками, применительно к оценке качества сайта – не обращайте внимания на таких товарищей и критически отнеситесь ко всем их россказням.

Теперь о RankBrain и сотне прочих работающих факторах ранжирования

. Хотелось бы сразу отметить одну важную штуку. Сайт должен быть не только полезен пользователю, но и удобен для работы. Что сразу переводит нас в плоскость обсуждения UI/UX дизайна и вынуждает соблюдать массу требований, начиная с классических «трех кликов до нужного контента», расположении блоков на странице, адаптацией под мобильные, скорость отображения сайта и пр…

Каждое из этих требований будет обусловлено десятком взаимопереплетающихся факторами ранжирования.

Ну возьмем, например, CTR в органике. Чем он выше, тем больше товарищей придет на ваш сайт. Более того, повышая CTR на 3-4%, Гугл поднимет в выдаче на 1 позицию, что автоматом опять позволит нарастить трафик.

В свою очередь CTR зависит от яркости сниппета, который порождается как тайтлом и дескрипшеном, так и контентом, в зависимости от запроса в органике.

Есть десятки стандартных приемов, повышающих заметность сниппета, основанных как на психологии, так и на манипуляции техникой.

К примеру, стандартные сниппеты в Гугле – 2 строки, а я могу заставить Гугл для моих страниц формировать 4-х строчные сниппеты. Под этими 4 строками текста могу прикрутить «хлебные крошки» и оценку страницы (звездочки). Такой снипет будет очень «выпуклым» и заметным в выдаче. Это и есть технические манипуляции.

А есть психологические приемы. Все эти списки (100 приемов… 25 способов), крючки и завлекалки. Это тоже позволяет повысить CTR.

Однако, если пользователь, перейдя на страницу, не найдет того, что ему обещали в сниппете, то никакой конвертации посетителя не будет. И тут мы опять возвращаемся к полезности контента.

Для себя я пользуюсь такой техникой составления Титла – в нем должно быть 2 части. В первой говориться о чем эта страница, во второй – как она может помочь посетителю. Аналогично с дескрипшеном.

Можно привести сотни приемов и способов того, что сегодня хорошо и очень хорошо работает в Гугле. Как раз сейчас я заканчиваю книжку «SEO Монстр 2018» , там в одном из разделов будут описаны эти нехитрые, но полезные и неочевидные приемы.

Возвращаясь к тому же CTR и психологическому приему списков, вы, например, знали, что целые числа в тайтле работают на 10-15% лучше, чем некруглые и что «100 приемов продвижения» в тайтле для посетителя будут привлекательней чем «112 приемов продвижения». Странно, да? Но это психология. И это работает.

В SEO все взаимосвязано. И любая манипуляция, которая будет полезна для конечного пользователя, будет положительно влиять как на позиции в органике, так и на трафик, конвертации и в конечном счете, прибыль.

В этом и заключается хитрость всего SEO. А все остальное – это всего-навсего техника и хитрые и не очень хитрые приемы оптимизации.

С чем согласны, с чем не согласны? Какой у вас опыт продвижения под Гугл и Яндекс? Пишите в комментариях ниже!

Все мои проекты, кроме этого SEO-блога:

ТОП База - качественная база для полуавтоматической регистрации с Allsubmitter или для полностью ручного размещения - для самостоятельного бесплатного продвижения любого сайта, привлечения целевых посетителей на сайт, поднятия продаж, естественного разбавления ссылочного профиля. Базу собираю и обновляю 10 лет. Есть все виды сайтов, все тематики и регионы.

SEO-Topshop - SEO-софт со СКИДКАМИ, по выгодным условиям, новости SEO-сервисов, баз, руководств. Включая Xrumer по самым выгодным условиям и с бесплатным обучением, Zennoposter, Zebroid и разные другие.

Мои бесплатные комплексные курсы по SEO

- 20 подробных уроков в формате PDF.

- каталоги сайтов, статей, пресс-релизовые сайты, доски объявлений, каталоги фирм, форумы, соцсети, блоговые системы и прочее.

"Приближаясь.." - мой блог на тему саморазвития, психологии, отношений, личной эффективности

Чтобы определить, какие ресурсы наиболее соответствуют тем или иным запросам, поисковые системы учитывают множество факторов ранжирования: соответствие поискового запроса контенту сайта, присутствие ключевых слов в основных мета-тегах и тексте документа, возраст и история домена, авторитетность страниц, скорость загрузки страницы и другие технические аспекты – всего более 800 параметров у Яндекс и не менее 271 у Google .

Подробнее остановимся на факторах, возникающих в результате действий посетителя, именуемых поведенческими. Чтобы определить, какие сайты больше нравятся людям, поисковики собирают статистику – какой сайт пользователи добавили в закладки, сколько времени на нем провели, сколько страниц посетили, какие сайты чаще выбирают из выдачи и так далее.

Эти факторы можно разделить на два вида:

- Формируемые в поисковой выдаче.

- Формируемые внутри сайта.

Внешние поведенческие факторы

Кликабельность

Если ваш сайт, находясь в выдаче ниже, чем конкуренты, при этом кликается чаще – это сигнал для поисковой системы повысить его позицию в результатах поиска. Это достигается путем повышения качества сниппета – небольшого отрывка текста со страницы, попавшей в выдачу. Так как в большинстве случаев в его роли оказываются мета-теги title и description, улучшая их, мы улучшаем и сниппет.

Так выглядят сниппеты в поисковой выдаче.

Возврат к поисковой выдаче

Этот фактор помогает в измерении естественного ранжирования. Система вычисляет, как быстро человек вернулся к поиску после того, как побывал на сайте, и делает вывод, смог ли он получить ответ на запрос. Если возврата не произошло, значит, результат его удовлетворил.

Переходы из социальных сетей и других ресурсов

Такое поведение пользователей говорит о том, что сайт интересен людям, поэтому поисковики повышают его в выдаче.

Внутренние поведенческие факторы

Для каждого типа сайта и поискового запроса внутренние поведенческие факторы будут иметь индивидуальный набор идеальных показателей.

Эти факторы являются очень важными для ранжирования, но в какой именно степени они оказывают влияние, сказать сложно – алгоритмы поисковых систем оценивают все в комплексе.

Формируя выдачу под каждый вид запроса, поисковик ожидает определенного – разного для каждого вида – поведения пользователя. К примеру, если пользователь ищет руководство по эксплуатации утюга конкретной модели, можно сделать вывод, что его интересует скорейшее получение результата. Яндекс и Google в данном случае ожидают, что люди не будут просматривать несколько страниц на ресурсе в поисках ответа и лучше всего, если он будет находиться на целевой странице. А если человек вводит запрос ”красивые обои на рабочий стол” , то вероятнее всего изучит сайт и его разделы и просмотрит большое количество страниц.

Показатель отказов

Это процент посетителей, которые покинули сайт со страницы входа в течение 15 секунд. Причин этому может быть много: низкая скорость загрузки, несовременный дизайн, низкие показатели юзабилити, несоответствие контента сайта поисковому запросу и так далее.

Для разных типов сайтов нормы будут разными. К примеру, совершенно нормально, если человек зашел в блог прочитать статью, провел там достаточно для чтения времени и покинул, получив ответ на свой вопрос.

Глубина просмотра

Данный показатель показывает количество страниц, просмотренных посетителем за одну сессию. Это важный показатель активности и заинтересованности посетителей.

Если пользователь посещает несколько страниц сайта за один визит, это свидетельствует об общей полезности ресурса не только по заданному запросу.

Для разных типов сайтов (интернет-магазин, социальная сеть, информационный портал) будет считаться оптимальной разная глубина просмотра. Поэтому определить, какая является нормой для вас, можно только в динамике.

Глубина просмотра тесно связана с временем, проведенным на сайте, и оба фактора стоит учитывать в связке. Чем больше пользователь посетит заинтересовавших его страниц, тем больше времени на сайте он проведет. Но если он просмотрел много страниц за короткий промежуток времени, и конверсия при этом низкая – это может указывать на непонятную навигацию и запутанную структуру.

Анализируйте с помощью Яндекс.Метрики и Google Analytics поведение пользователей: каким маршрутом приходят на ту или иную страницу, на каких задерживаются, почему не достигают целевой страницы (например, оплаты заказа).

Увеличить глубину просмотра и тем самым улучшить пользовательские факторы помогает расстановка внутренних ссылок на страницы с дополнительной информацией по теме.

Время пребывания

Учитывается как время, проведенное на сайте в целом, так время пребывания на конкретной странице. Это помогает алгоритмам лучше определить соответствие каждой из них запросу пользователей.

Чем больше времени пользователь проводит на странице, тем выше вероятность того, что он изучил всю предоставленную информацию и получил искомый ответ. Например, если на странице большой объём текстовой информации, а пользователь покинул сайт раньше, чем требуется времени на ее прочтение, это свидетельствует о том, что контент оказался ему не интересен.

Чтобы увеличить время, проводимое пользователями на сайте, нужно позаботиться о полезном и информативном содержимом.

В “Яндекс.Метрике” учитывается разница между длительностью первого и последнего просмотра на протяжении одной сессии. При этом, если посетитель открыл и не обновлял страницу, время, проведенное на сайте, будет считаться равным нулю. Также, если пользователь открыл сайт, но не совершал никаких действий на протяжении получаса, а затем перешел на другую страницу внутри сайта – это будет считаться началом новой сессии (новым визитом).

В Google Analytics среднее время пребывания на сайте определяется отношением общей длительности пребывания к количеству сеансов. Для определения продолжительности одного сеанса учитывается активность на странице. При бездействии посетителя сеанс автоматически заканчивается через 30 минут. Стоит пользователю проявить активность, параметр “время окончания сеанса” сдвигается на полчаса.

Пример сессий Google Analytics

Пример сессий Google Analytics

Повторное посещение

Повторное посещение сайта одним и тем же пользователем свидетельствует о том, что сайт заинтересовал его предоставляемой информацией. Совсем хорошо, если он добавил сайт в закладки.

Посещаемость

Чем больше ресурс посещаем по низкочастотным запросам, тем выше его шансы продвинуться в ТОП по высокочастотным.

Активность

В конечном итоге важно, достиг ли пользователь цели или нет. Поэтому все остальные факторы следует учитывать в связке с этим.

Как улучшить поведенческие факторы

Качественный контент

Наполнение сайта действительно интересным и уникальным контентом поможет привлечь и заинтересовать посетителей. Разбавляйте текстовую информацию визуальной – фотографиями и инфографикой. Пользователи лучше реагируют на такой контент и легче воспринимают его. А добавление видео увеличивает время, проведенное на странице.

Юзабилити

Показатель юзабилити напрямую влияет на конверсию. Тяжелый или устаревший дизайн, неудобная навигация и обилие всплывающих окон могут отпугнуть посетителя и увеличить процент отказов.

Навигация на сайте должна быть интуитивно понятна, а его ненавязчивый дизайн – соответствовать тематике и не мешать восприятию контента. И конечно, прежде всего стоит провести техническую оптимизацию сайта: исключить технические ошибки, избавиться от дубликатов страниц, проработать структуру и так далее.

О том, как создать удобный и продающий сайт, повысить юзабилити существующего и сформировать привлекательные триггеры для повышения конверсии на тематическом семинаре Дмитрия Шучалина, спикера нашего обучающего центра.

Привлекательный сниппет

Сниппет – это первое, что пользователи видят в выдаче. На его основании они определяют, насколько сайт удовлетворяет их запросу.

Сниппет должен кратко отражать суть информации, размещенной на сайте – не стоит писать в нем о том, чего пользователь на странице не найдет. Это поможет улучшить конверсию и снизить процент отказов.